Algorithm

重参数化技巧与 Gumbel-Softmax 详解

讲清楚连续重参数化与 Gumbel-Softmax 的推导、直觉与实现:为什么梯度能穿过采样节点,温度参数如何权衡偏差-方差,以及离散变量端到端训练的常见坑。

矩阵低秩近似与伪逆:从 SVD 到正则化

从最小二乘视角讲解 Moore-Penrose 伪逆的定义、Penrose 四条件、SVD 计算、截断奇异值与正则化,以及在机器学习中的落地应用。

浅谈位置编码:从 Sinusoidal 到 RoPE 与 ALiBi

系统梳理 Transformer 位置编码:为什么 Attention 需要它、绝对/相对/RoPE/ALiBi 各方案怎么算、长上下文外推时哪种最稳,以及如何为新模型选型。

变分自编码器 (VAE):从直觉到实现与调试

从零用 PyTorch 构建 VAE。涵盖 ELBO 目标函数、重参数化技巧、后验坍塌修复、beta-VAE,以及完整的训练流水线。

优化理论(十二):离散与全局优化

当变量为整数或问题为具有多个局部极小值区域的非凸问题时,经典凸优化方法失效;本文综述了有效方法:基于分支定界的整数规划、线性规划松弛间隙分析、启发式算法分类(粒子群优化、遗传算法、螺旋优化、模拟退火),以及螺旋优化算法在约束均值-方差投资组合优化中的深入应用。

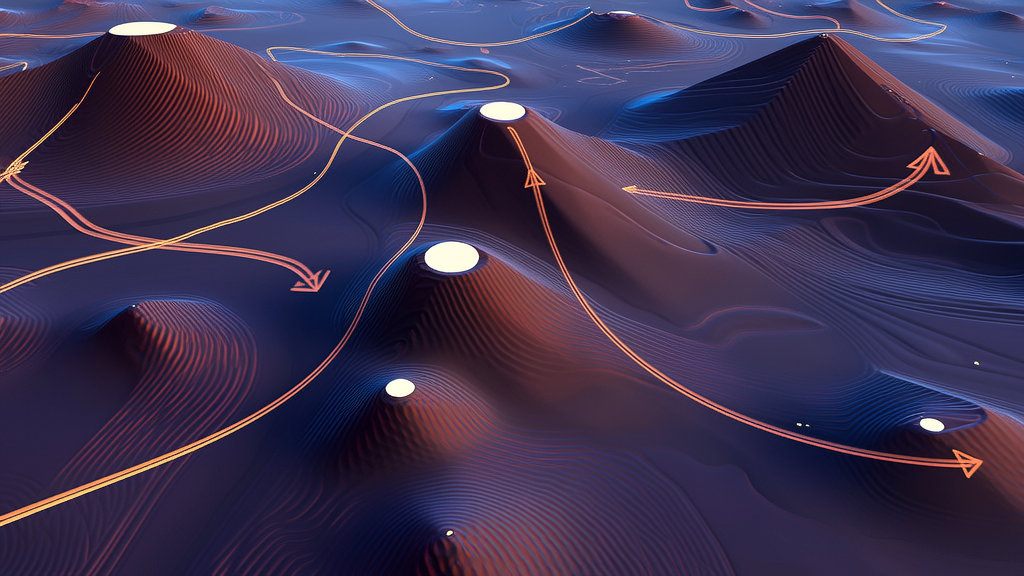

优化理论(十一):非凸优化与鞍点逃逸

为何 SGD 能在非凸景观下有效训练神经网络?我们证明扰动梯度下降可在多项式时间内逃离严格鞍点,在 Polyak-Łojasiewicz 条件下推导其收敛性,并综述深度学习损失曲面的已知理论结果——过参数化、神经正切核(NTK)及对平坦极小值的隐式偏好。

优化理论(十):随机优化与方差缩减

SGD 为何有效?我们基于梯度噪声预算证明了其在凸函数下的 $O(1/\sqrt{T})$ 收敛率与强凸函数下的 $O(1/(\mu T))$ 收敛率;进而介绍方差缩减方法——SVRG、SAGA、Katyusha,它们利用随机样本达到全梯度下降的线性收敛速率,并完整解析其理论机理。

优化理论(九):内点法与自和谐障碍函数

内点法何以成为凸规划默认求解器:以对数障碍函数替代不等式约束,参数化中心路径,并应用牛顿法;涵盖自协调性理论及著名的 $O(\sqrt{n} \log(1/\varepsilon))$ 迭代复杂度证明。

优化理论(八):Lagrangian 对偶与 KKT 条件

约束如何转化为价格:拉格朗日函数、弱对偶性、保证强对偶性的 Slater 条件、KKT 条件作为最优性的充要条件,以及为何 SVM 的对偶问题远小于其原始问题;包含完整证明与鞍点表征。

优化理论(七):二阶方法

二阶方法通过利用曲率突破 $\sqrt{\kappa}$ 瓶颈;我们证明牛顿法的局部二次收敛性,从割线条件与低秩更新导出 BFGS,详解适用于中等规模机器学习的 L-BFGS 双循环递推,分析带狗腿法求解的信任域子问题。

优化理论(六):复合优化与近端方法

系统讲解近端算子的理论与应用:凸分析基础、Moreau 包络、常见近端闭式解,以及 ISTA/FISTA、ADMM 等算法中的实际用法。

优化理论(五):Nesterov 之外的加速

一阶优化方法“最优”究竟意味着什么?我们证明了与 Nesterov 速率相匹配的紧致下界,将 Polyak 重球法导出为其连续时间极限,构建了统一的 Lyapunov 分析框架以同时涵盖二者,并揭示 Catalyst 元算法如何将任意求解器提升至加速收敛速率。

优化理论(三):梯度下降族——从 SGD 到 AdamW

一篇文章串起 GD → SGD → Momentum → NAG → AdaGrad → RMSProp → Adam → AdamW,再到 Lion / Sophia / Schedule-Free 的完整脉络:每一步解决了前一步的什么痛点?为什么大模型几乎都在用 AdamW?以及 2023 年之后我们究竟走到了哪里。

优化理论(二):光滑性、强凸性与 Nesterov 加速

用三个核心概念理清优化直觉:Lipschitz 光滑性决定步长上限,强凸性决定收敛速度与解的唯一性,Nesterov 加速在不牺牲稳定性的前提下加速到达。含关键定理证明与最小二乘实验对比。

优化理论(一):凸分析基础

解锁本系列后续内容的几何与分析工具包:凸集、凸函数、共轭(Fenchel)变换、次梯度,以及示性函数/支撑函数对;包含詹森不等式、投影定理及基本范数次微分的完整证明。