计算机基础(五):网络、电源与故障排查

深入剖析网卡的 PHY/MAC/DMA 流水线、TCP 三次握手、网络拓扑、电源 80 PLUS 效率曲线、数据中心 PUE、组件功耗层次以及 UPS 体系结构。

主板上明明是千兆网卡,为什么有时只能跑出 100 Mbps 的速度?崭新的 650 W 金牌电源,为什么显卡一吃满就重启?机房旁边的房间为什么常年比别处暖几度?这些日常现象背后,隐藏着两套大多数人从不深究的系统:承载数据的网络 I/O 流水线和让芯片活下去的电源与冷却链路。

本文是《计算机基础》系列的最终篇。这一次,我们不再罗列规格表,而是跟着数据和能量走一遭:从墙上的双绞线经过 PHY、MAC、DMA 引擎一路进入内存;从墙上的插座经过电源的转换电路最终供给显卡上的 12 V 供电。沿途还会看到数据中心如何用 PUE 指标量化能源浪费,以及 UPS 如何在电网抖动时撑住整间机房。

系列导航#

计算机基础深度剖析系列(共 6 篇):

- CPU 与计算核心

- 内存与高速缓存

- 存储系统详解

- 主板、显卡与扩展接口

- 网络、电源管理与故障诊断 (本文档)

- 深度拓展:跨领域专题解析

第一部分:网卡究竟是如何工作的#

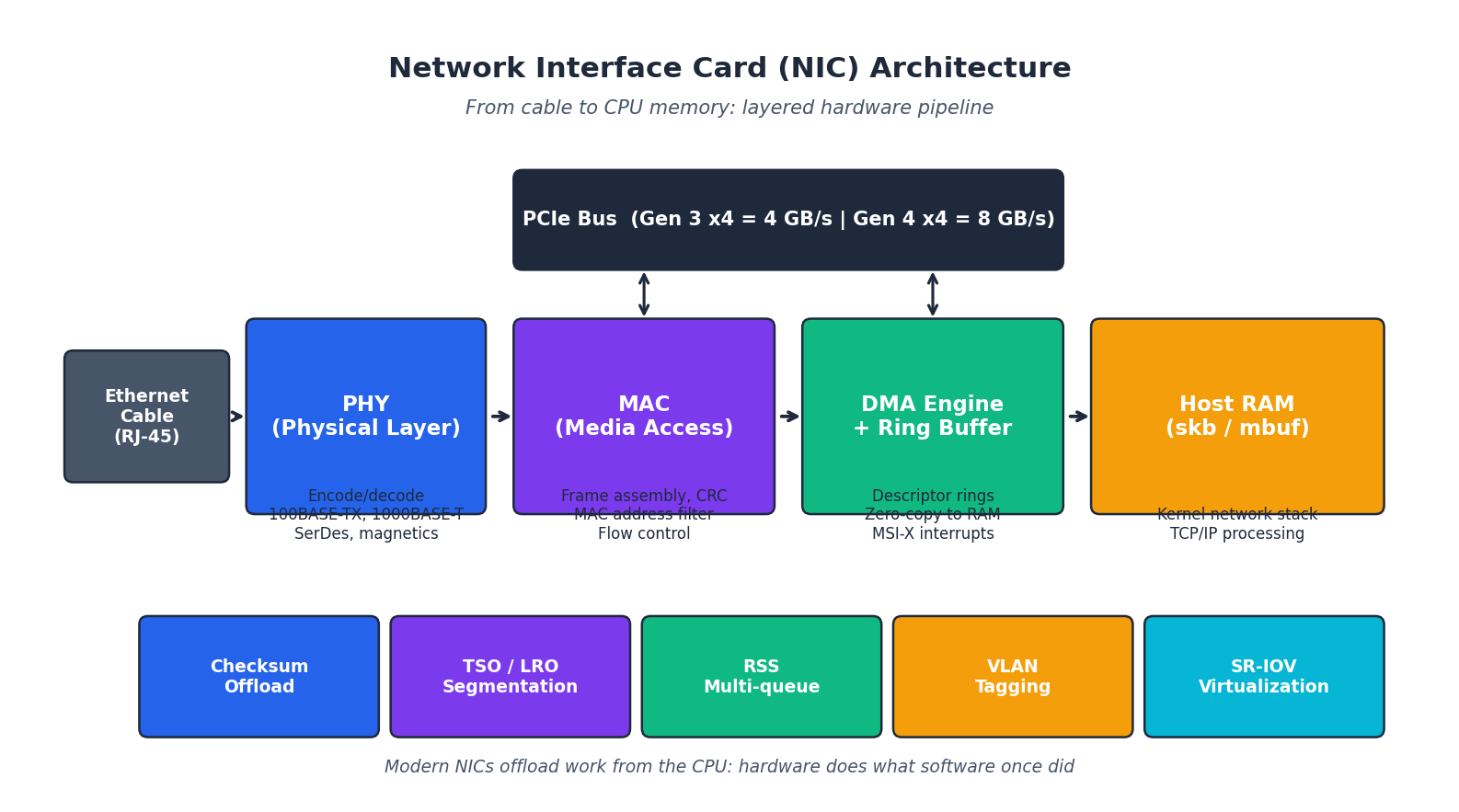

提到网卡,很多人可能只会想到“机箱后面的那个接口”。但实际上,这个接口背后藏着一套高度专业化的独立子系统,负责将双绞线上传输的电信号转换为内核能处理的数据包。整个过程完全在硬件层面完成,几乎不需要 CPU 介入,同时还能稳定地跑满线路的最大带宽。

硬件中的三层结构#

| 阶段 | 功能 | 常见问题 |

|---|---|---|

| PHY(物理层) | 负责 SerDes、信号调理和磁性元件处理;在 4 对双绞线上以 125 MHz 实现 1000BASE-T 编码 | 使用低规格网线(如 CAT5 而非 CAT5e+)、跳线弯折过度、电源靠近线缆引发 EMI 干扰 |

| MAC(媒体访问控制) | 负责帧组装、CRC 校验、MAC 地址过滤、流控(PAUSE 帧)以及巨帧支持 | 交换机与网卡 MTU 不匹配;对端设备异常导致的流控风暴 |

| DMA + 环形缓冲区 | 网卡通过收发描述符环直接将数据帧写入内核分配的 skb(Linux)或 mbuf(BSD),并通过 MSI-X 中断唤醒对应 CPU 核 | 单核处理能力不足时,环形缓冲区溢出(ifconfig 中的 RX-DRP 指标升高);可通过 RSS 多队列分散负载解决 |

除上述组件外,还有一系列硬件卸载引擎,是实现 25/40/100 GbE 高速网络的关键:

- 校验和卸载——TCP/IP 校验和由硬件完成。

- TSO / LRO——发送分段卸载(TSO)和接收聚合卸载(LRO)将逐包处理任务交给硬件。CPU 只需传递一个 64 KB 的数据块给网卡,网卡会自动将其拆分为 44 个适合传输的帧。

- RSS(接收侧扩展)——通过 Toeplitz 哈希算法将不同流量分布到多个 CPU 核心。如果没有 RSS,单条 25 GbE 流量可能打满一个核心,导致整台机器性能瓶颈。

- VLAN 标签和SR-IOV——后者允许将一张物理网卡虚拟为多个虚拟功能(VF),每个虚拟机独占一个 VF,从而绕过 hypervisor 的软件交换路径。

千兆网络“缩水”到百兆?问题可能出在这儿#

如果你发现千兆网络(1000BASE-T)只能跑到 100 Mbps,别急着怀疑配置问题,罪魁祸首往往是网线。千兆以太网需要网线中的四对线芯全部正常工作,而较老的 CAT5 标准只保证两对线芯能稳定传输。更糟糕的是,市面上一些低价跳线为了节省成本,往往在规格上偷工减料,表面上标着 CAT5e,实际性能却达不到要求。解决这个问题的关键是更换网线,而不是折腾软件。

| |

有线网卡标准(2024 年现状)#

| 标准 | 线速 | 实际吞吐量 | 常见应用场景 |

|---|---|---|---|

| 百兆 (Fast Ethernet) | 100 Mb/s | ~12 MB/s | 老旧 IoT 设备、传统交换机 |

| 千兆 (Gigabit) | 1 Gb/s | ~118 MB/s | 当前主流设备的默认配置 |

| 2.5G | 2.5 Gb/s | ~295 MB/s | 高端家用主板、Wi-Fi 6 回程网络 |

| 万兆 (10GBASE-T / SFP+) | 10 Gb/s | ~1.18 GB/s | NAS 存储、高性能工作站、服务器接入端口 |

| 25/40/100G | 最高 100 Gb/s | 最高 12.5 GB/s | 数据中心 spine-leaf 架构,SFP28/QSFP28 光纤连接 |

Wi-Fi 标准#

| 标准 | 频段 | 理论最高速率 | 发布年份 |

|---|---|---|---|

| Wi-Fi 4(802.11n) | 2.4 / 5 GHz | 600 Mb/s | 2009 |

| Wi-Fi 5(802.11ac) | 5 GHz | 3.5 Gb/s | 2013 |

| Wi-Fi 6(802.11ax) | 2.4 / 5 GHz | 9.6 Gb/s | 2019 |

| Wi-Fi 6E | 2.4 / 5 / 6 GHz | 9.6 Gb/s,6 GHz 干扰更少 | 2021 |

| Wi-Fi 7(802.11be) | 2.4 / 5 / 6 GHz | 46 Gb/s,支持 MLO | 2024 |

如果是 2024 年的新装机方案,Wi-Fi 6 或 6E 是最佳选择:主流 AP 和终端设备均已全面支持,而且 6 GHz 频段目前仍然较为干净,干扰较少。

第二部分:TCP,隐藏在背后的对话#

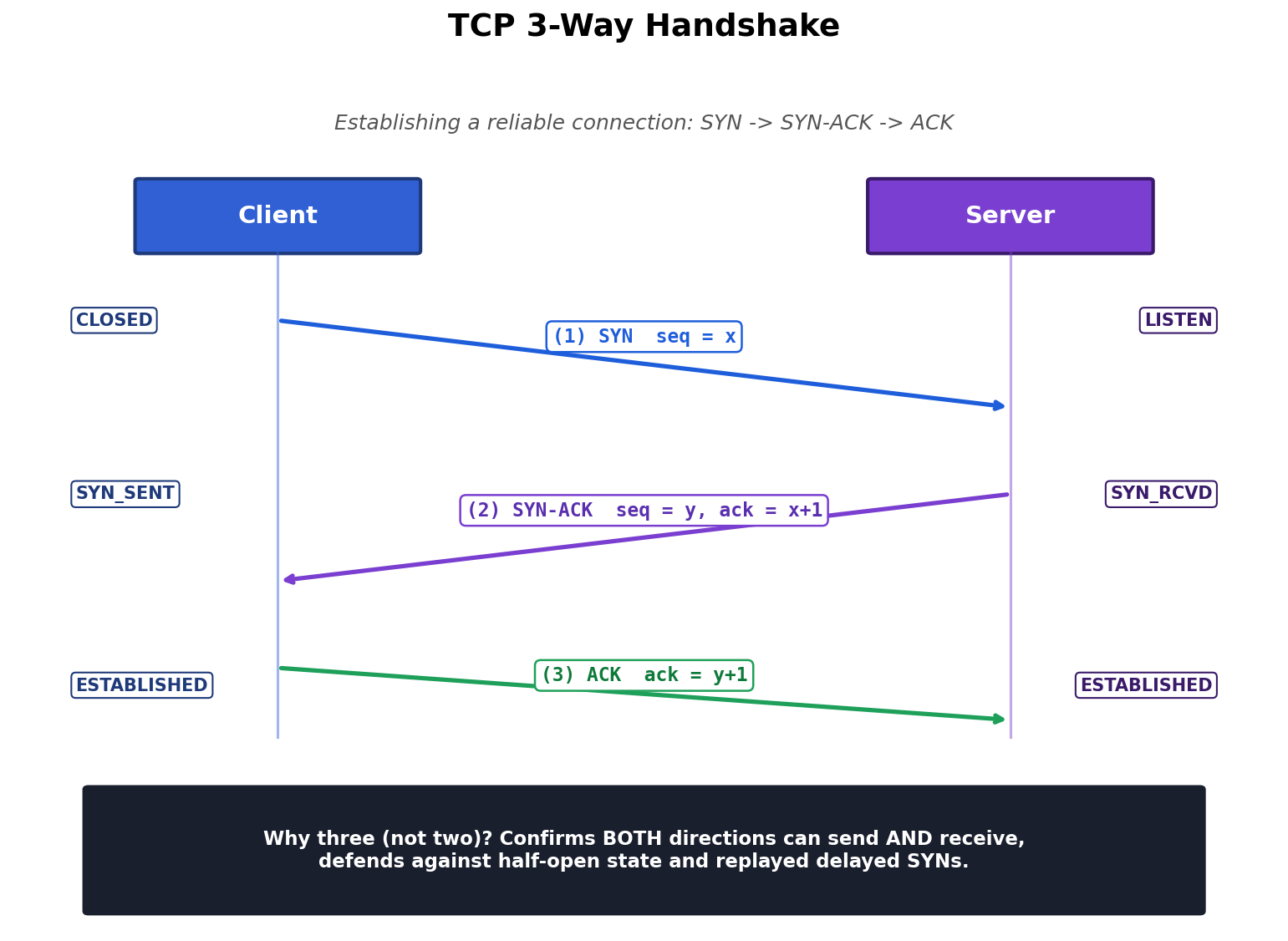

无论是访问网页、启动 SSH 会话,还是执行数据库查询,所有这些操作的背后都离不开一个微小但至关重要的“三步握手”仪式。搞清楚这个过程,能让你在网络连接超时的时候,从盲目猜测转变为精准诊断。

为什么需要三次握手,而不是两次?#

你可能会想:“客户端打个招呼,服务端回个招呼,搞定。”但 TCP 之所以需要第三次握手,是因为它必须确保双向通信的能力都正常:

- SYN(客户端 → 服务端):“我想和你建立连接,我的初始序列号是

x。” - SYN-ACK(服务端 → 客户端):“我收到你的请求了(

ack = x+1),我的初始序列号是y。” - ACK(客户端 → 服务端):“我也收到你的消息了(

ack = y+1),现在我们可以开始通信了。”

在第二步完成后,服务端已经确认客户端可以发送数据;而第三步完成后,双方才真正确认了双向通信的可行性。如果少了第三步,服务端会卡在 SYN_RCVD 状态——这正是经典 SYN 洪水攻击所利用的半开连接状态。

用 tcpdump 观察握手过程#

| |

你和目标机器之间交换的这三个仅包含标志位、没有实际数据的包,就是 TCP 握手的过程。完成握手后,通信会进入数据传输阶段,每个数据段都会携带自己的序列号,用于确保数据按顺序交付以及支持重传机制。

建立连接的成本#

每次新建 TCP 连接时,都需要先花费一个往返时间(RTT)完成握手,之后才能开始传输实际数据。对于同一数据中心内的服务器(RTT = 0.5 毫秒),这种开销几乎可以忽略不计;但对于跨大西洋的 API 调用(RTT = 100 毫秒),这一步却成为了延迟的主要来源。正因如此,HTTP/2 选择通过单条连接复用多个请求,而 HTTP/3(QUIC)更进一步,将 TLS 握手整合到同一个往返过程中,从而显著减少延迟。

第三部分:网络拓扑——成本与可靠性的权衡#

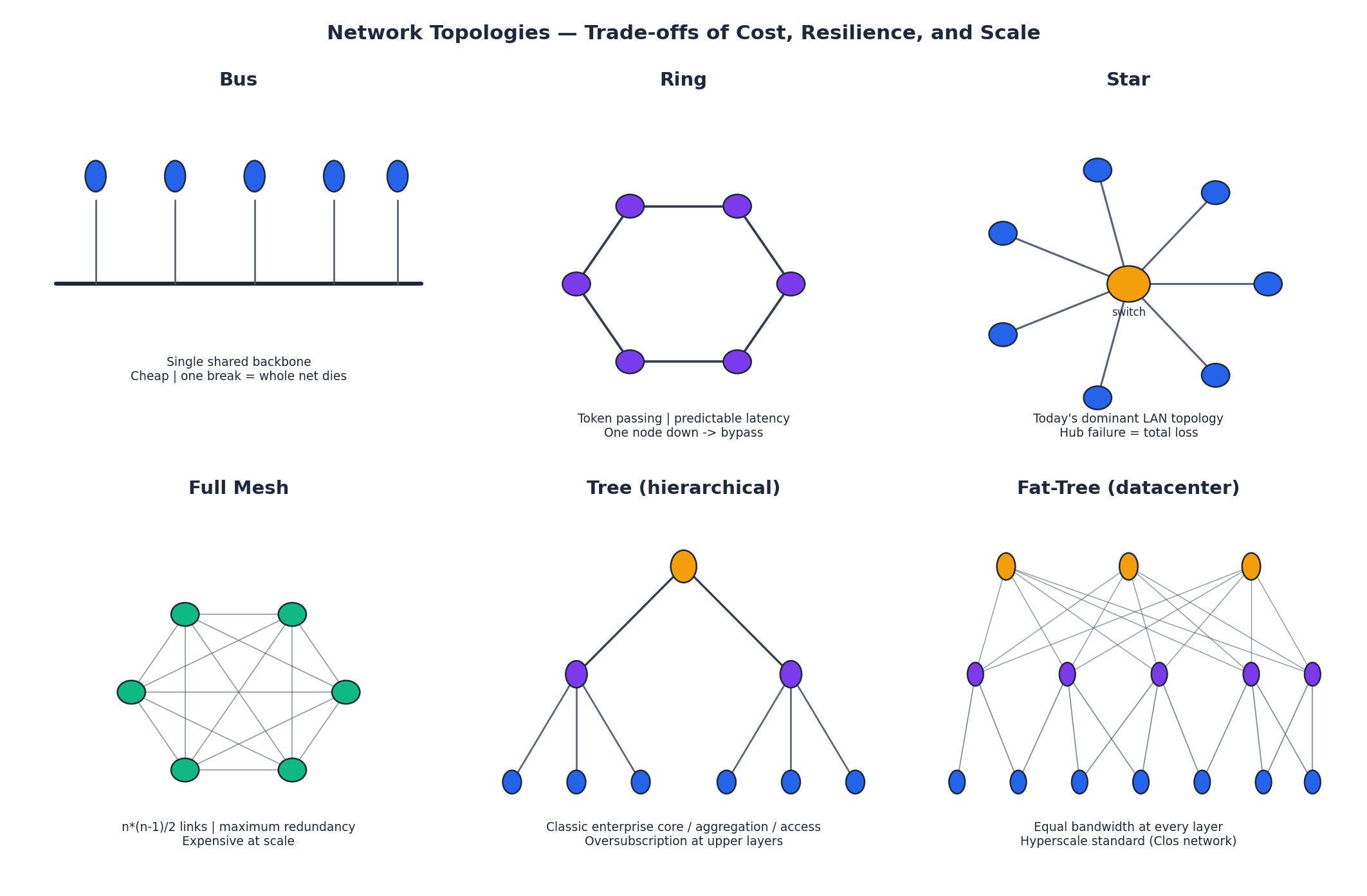

如何将 4 台、40 台甚至 4000 台设备连接起来?这里有六种经典方案,每种都有其独特的带宽特性和容错表现:

| 拓扑结构 | 连接数 | 故障特性 | 当前典型应用场景 |

|---|---|---|---|

| 总线 | 共享一条主干线路 | 一处中断 = 全部瘫痪 | 历史遗留的 10BASE2 同轴电缆;工业 CAN 总线 |

| 环形 | 每个节点与其邻居相连 | 单点故障可绕行 | 曾经的 Token Ring 网络,SONET 和 FDDI |

| 星型 | 每个节点连接到中心节点 | 中心节点故障 = 全部瘫痪 | 现代局域网的标准架构——每台以太网交换机就是一个星型核心 |

| 全网状 | n*(n-1)/2 | 冗余性最强 | 小规模核心路由器组;难以大规模部署 |

| 树形 | 分层设计 | 上层节点故障 = 子树整体失效 | 经典的企业三层架构(核心 / 汇聚 / 接入) |

| 胖树(Clos) | 每层带宽一致 | 多条并行路径,支持 ECMP 负载均衡 | 超大规模数据中心的首选——AWS、Google、Azure 都采用这种架构 |

胖树架构是实现超大规模数据中心的关键所在。在传统的树形架构中,越靠近顶层,链路的带宽收敛比越高:例如,48 台服务器共享一条 10 Gb 的上联链路,每台服务器实际只能获得名义带宽的 1/48。而胖树通过让每一层的总带宽保持一致,解决了这一问题。扩容时只需增加 spine 节点,而无需购买更高性能的单体交换机。

第四部分:网络寻址——真正需要懂的那几个概念#

0.0.1——本地回环地址#

127.0.0.1 是计算机用来与自身通信的特殊地址。发送到这个地址的数据包完全不会经过物理网卡,而是在内核的网络协议栈中直接“短路”处理。这就是为什么即使拔掉网线,执行 curl http://localhost:8080 依然能够正常工作的原因。实际上,整个 127.0.0.0/8 网段都属于回环地址范围,无论是 127.0.0.1 还是 127.5.6.7,都可以用于本地回环通信。

0.0.0——“任意网络接口”#

0.0.0.0 的具体含义取决于上下文,通常可以分为两种用途:

- 作为绑定地址(服务端):表示“监听所有可用的网络接口”,比如

eth0、wlan0和lo等。在 Flask 框架中,app.run(host='0.0.0.0')就是用来实现这一功能的,意味着服务器会接受来自任何网络接口的连接请求。 - 作为路由目标:表示“默认路由”,在路由表中通常写作

0.0.0.0/0,用于匹配所有未明确指定的流量。

一个常见的误区是将 0.0.0.0 当成可以直接访问的目标地址,例如尝试用 curl 或 ping 来操作它。这是错误的!0.0.0.0 并不是一个实际的目的地,而是一个通配符,意思是“任意地方”。

| 绑定地址 | 可访问范围 | 典型应用场景 |

|---|---|---|

127.0.0.1 | 仅限本机 | 本地开发调试、安全性要求高的服务 |

192.168.1.100(指定 IP) | 仅限该网卡对应的网络 | 多网卡主机根据不同接口提供差异化服务 |

0.0.0.0 | 所有网络接口 | 生产环境中的通用服务部署 |

端口——服务的多路复用#

一个 IP 地址可以同时运行成千上万个服务,这得益于端口号(16 位,范围 0–65535)来区分不同的服务。其中,前 1024 个端口被称为“知名端口”,它们通常被一些常见的服务占用:

| 端口 | 协议 | 服务 |

|---|---|---|

| 22 | TCP | SSH |

| 53 | UDP | DNS |

| 80 | TCP | HTTP |

| 443 | TCP | HTTPS |

| 3306 | TCP | MySQL |

| 6379 | TCP | Redis |

| 27017 | TCP | MongoDB |

很多工程师都遇到过这样的问题:“ping 能通,但网站却访问不了。”其实原因很简单:ping 使用的是 ICMP 协议(不涉及端口),而访问网站需要有服务进程绑定到 TCP 的 80 端口。主机网络是通的,但可能是服务没有启动,或者服务只绑定了 127.0.0.1,而不是 0.0.0.0。

| |

NAT——用 40 亿地址撑起 300 亿设备的魔法#

IPv4 地址总数大约是 42 亿,但如今全球联网设备的数量远远超过这个数字。那么,这么多设备是如何共存的呢?答案就是 网络地址转换(NAT)。简单来说,NAT 让家庭或企业内部的所有设备共享一个公网 IP 地址:路由器在数据包发出时改写源地址,而当响应返回时,再将目标地址映射回对应的内部设备。

| |

路由器会将这些地址映射关系存储在内存中,形成一张 NAT 表。不过,这张表中的条目并不是永久有效的,如果某个连接长时间没有活动,对应的记录就会被自动清除。这也就是为什么有些 SSH 会话在闲置一段时间后会突然断开——因为 NAT 表已经把它“遗忘”了。

DNS——互联网的地址簿#

计算机通过 IP 地址进行通信,但人类更容易记住名字。DNS 的作用就是将 www.example.com 转换为对应的 IP 地址 93.184.216.34,它背后是一条递归查询链:

- 首先检查浏览器缓存 → 2. 接着查看操作系统缓存(优先读取

/etc/hosts文件) → 3. 然后交给递归解析器(比如你的 ISP 提供的解析服务,或者公共 DNS 如1.1.1.1) → 4. 再依次向上查询根服务器、.com顶级域名服务器,最终到达example.com的权威服务器 → 返回 A 记录。

CDN 技术正是利用了这一机制,根据用户的地理位置返回不同的 IP 地址。这就是为什么你在访问 www.netflix.com 时,解析结果会指向你所在城市的服务器,而不是远在加州的源站。

第五部分:虚拟机网络模式#

在 VMware、VirtualBox 或 KVM 里跑虚拟机时,hypervisor 必须决定虚拟 NIC 怎么接到外部世界。三种经典模式:

桥接模式(Bridged)——虚拟机在局域网中独立存在#

在这种模式下,hypervisor 会提供一个虚拟交换机,将虚拟机的网卡直接桥接到物理网络中。虚拟机会像其他设备一样,从家庭路由器获取一个 DHCP 分配的 IP 地址(例如 192.168.1.x),与宿主机处于同等地位。局域网中的其他设备可以直接访问这台虚拟机,比如通过 ping 命令进行连接测试。

适用场景:当你需要搭建一台测试用的 Web 服务器,并且希望同一局域网内的同事能够直接访问它时,这种模式非常合适。

NAT——虚拟机隐藏在私有虚拟路由器之后#

在这种模式下,hypervisor 本身扮演了一个小型路由器的角色。虚拟机会被分配到一个独立子网中的地址(例如,VMware 默认使用 192.168.182.x),而所有出站流量会经过两次 NAT 转换:第一次由 hypervisor 将流量映射到宿主机的 IP 地址,第二次则由家庭路由器将流量转发到公网 IP。

适合的场景:需要隔离环境的同时,仍然要保持网络连接。对于绝大多数开发用的虚拟机来说,这是最合适也是最稳妥的选择。

仅主机模式(Host-only)——完全隔离的网络环境#

在虚拟机(guest)和宿主机之间建立一条虚拟网线,不连接任何外部网络。既没有互联网访问权限,也不接入局域网(LAN)。这种配置非常适合用于恶意软件分析、物理隔离环境测试,或者运行那些“绝对不允许外部访问”的数据库服务。

| 特性 | 桥接模式 | NAT 模式 | 仅主机模式 |

|---|---|---|---|

| 虚拟机 IP 子网 | 与宿主机相同 | 独立的虚拟子网 | 完全隔离的子网 |

| 是否可从局域网访问 | 是 | 否(需端口转发) | 否 |

| 是否可访问外网 | 是 | 是 | 否 |

| 是否占用局域网 IP | 是 | 否 | 否 |

| 典型应用场景 | 测试服务器 | 日常开发 | 恶意软件沙箱 |

第六部分:网络排障——自底向上的方法#

网络问题虽然分为七层,但排查时的顺序与图示的层次相反:从最底层(物理连接、链路、IP)开始,逐步向上(TCP、TLS、应用层)推进。

| |

案例 1:能 ping 通,但网站无法访问#

主机能够响应 ICMP 请求,说明网络的第 1 到第 3 层都没有问题。问题可能出在第 4 层或更高层。

| |

通常导致这种情况的原因包括:nginx 服务未启动;nginx 启动了但只绑定了 127.0.0.1;防火墙规则阻止了 80 端口的访问;或者 AWS 安全组未开放 HTTP 入站权限。

案例 2:域名无法解析#

| |

如果 8.8.8.8 能通,但 DNS 解析失败,说明当前配置的解析器有问题。可以尝试将解析器替换为 1.1.1.1 或 8.8.8.8,然后重新测试。

案例 3:NAT 模式下虚拟机无法访问互联网#

| |

解决这个问题的常见方法包括:在宿主机上重启 VMware 的 NAT 服务,或者将 /etc/resolv.conf 文件的内容替换为 nameserver 8.8.8.8。

hosts 文件——本地 DNS 的覆盖机制#

/etc/hosts(在 Windows 系统中是 C:\Windows\System32\drivers\etc\hosts)会在发起任何 DNS 查询之前被优先检查。它本质上是一个简单的文本文件,用于将 IP 地址映射到域名:

| |

前两行的作用是将开发环境中的域名指向本机,方便本地调试;第三行则是一种最基础的广告拦截方式——访问这些域名时会被重定向到 0.0.0.0,从而静默失败。修改完 hosts 文件后,记得清理操作系统的 DNS 缓存以确保生效:

| |

第七部分:电源——最容易被忽视的核心组件#

电源是整个系统中唯一与所有其他硬件都直接关联的部件。然而,一个不稳定的电源(PSU)往往会引发各种看似与其他硬件相关的问题:内存(RAM)报错、显卡(GPU)异常、主板故障等等,唯独不会让人联想到是电源本身出了问题。尽管如此,大多数装机指南却仅仅把电源简单地视作一个“瓦数数字”,对其重要性一笔带过。

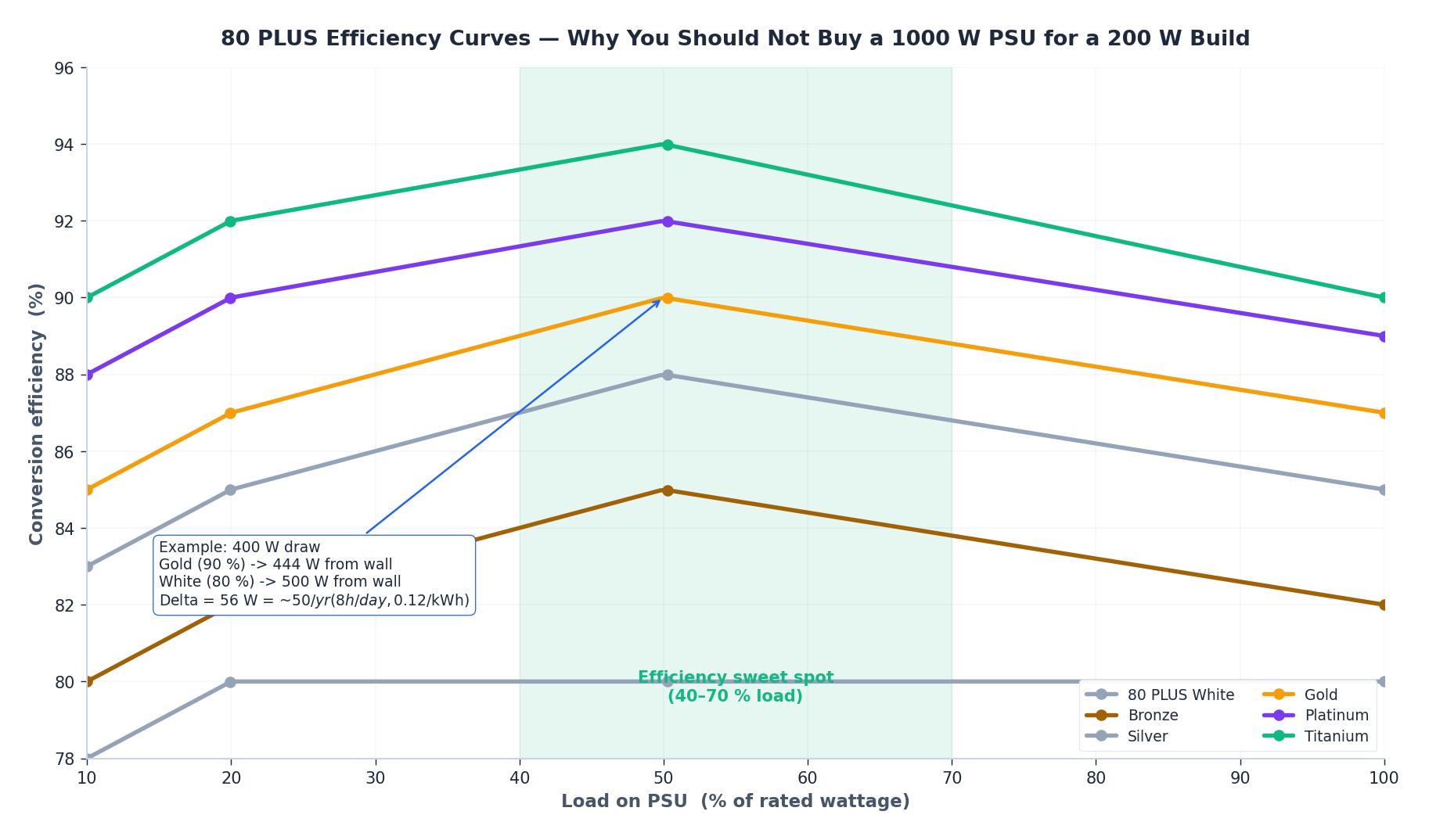

“80 PLUS"到底在测什么?#

电源的额定功率标明了它能为系统提供多少电力,而效率则反映了它在将墙上的交流电(AC)转换为 12 V、5 V 和 3.3 V 直流电时损失了多少能量。80 PLUS 认证正是基于四个不同的负载点来评估这种转换效率。

从这些曲线中可以挖掘出一些不太直观但很有意义的信息:

- 效率最高点通常出现在 40–70 % 的负载区间。 如果你用一台 1000 W 的电源去带一台 200 W 的主机,实际负载只有 20 %——正好落在效率最低的区间。选个功率过大的电源不仅多花了钱,长期运行还更费电。

- 钛金认证的优势主要体现在极端负载下。 在 50 % 负载时,金牌(90 % 效率)和钛金(94 % 效率)之间只差了 4 个百分点;但在 10 % 负载时——比如服务器夜间空闲运行的情况——钛金的优势就显现出来了。

- 省电的价值确实存在,但有限度。 假设一台 400 W 的电脑每天运行 8 小时,电费按每度电 0.6 元计算,使用白牌电源相比金牌每年会多浪费大约 56 W 的电量,折合电费约 350 元。金牌电源通常贵 200 元左右,使用寿命在 7–10 年之间——这笔账一算就清楚了。

如何正确计算电源功率#

通常的经验公式是 (CPU TDP + GPU TDP + 100 W) × 1.3。这里乘以 1.3 是为了应对瞬时功耗峰值(现代显卡在短时间内可能会超出其标称 TDP 的 30%)、电源转换效率的损耗,以及确保系统在长期运行时能够稳定处于电源效率曲线的最佳区间。

| 配置类型 | 持续功耗范围 | 推荐电源规格 |

|---|---|---|

| 办公(无独立显卡) | 80–120 W | 350–450 W,铜牌认证 |

| 轻量级游戏(RTX 3050) | 200–280 W | 500 W,金牌认证 |

| 主流配置(i5-13600K + RTX 4070) | 350–450 W | 650 W,金牌认证 ✅ |

| 高端配置(i9 + RTX 4080) | 550–700 W | 850 W,金牌/白金认证 |

| 工作站(i9 + RTX 4090) | 800–1100 W | 1200 W,白金认证 |

模组化与非模组电源的区别#

电源的线材设计主要分为三种类型:

- 非模组电源——所有线缆都直接固定在电源上,无法拆卸。这种设计成本最低,但理线效果最差,尤其在机箱内部显得杂乱无章。

- 半模组电源——必备的 24-pin 主板供电和 CPU 8-pin 供电线是固定的,而 PCIe 和 SATA 线缆可以按需拆卸。这种设计兼顾了实用性和整洁性,对大多数装机方案来说是最优解。

- 全模组电源——所有线缆都可以自由插拔。虽然价格比其他类型贵 100–200 元,但它能让小型化(SFF)主机的布线更加清爽,也方便日后更换或升级线材。

需要特别注意的是:不同品牌甚至不同型号的电源,其模组线绝对不能混用! 因为电源端的接口针脚定义并没有统一标准,比如将 EVGA 的模组线插入 Corsair 电源,可能会导致 12 V 电路通过 5 V 电路短路,进而引发整套系统的硬件损坏。

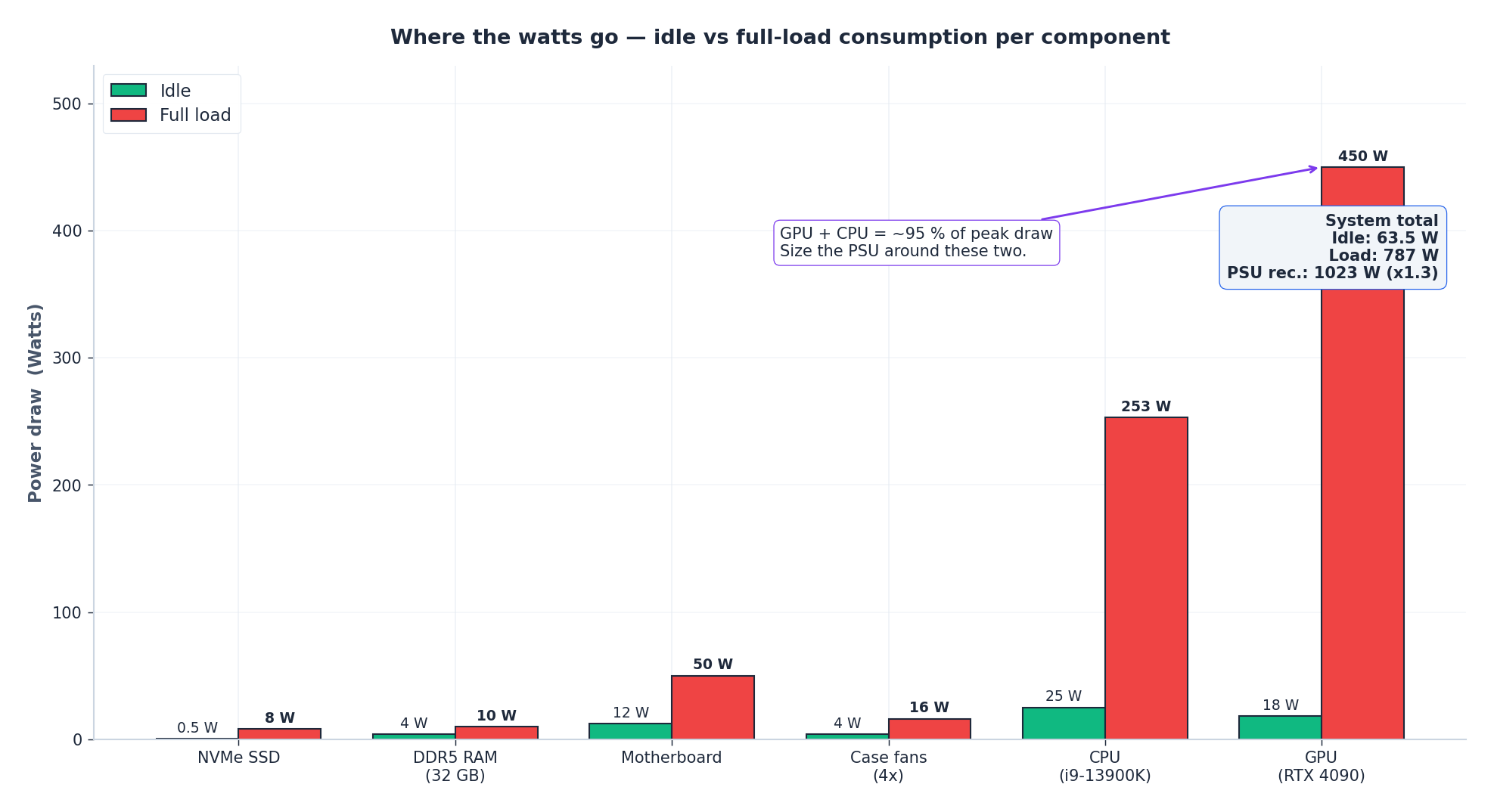

第八部分:组件功耗的优先级#

搞清楚哪些硬件是真正的“电老虎”,选电源的时候就不用再靠猜了。

这里有两点关键结论:

- CPU 和 GPU 合起来吃掉了 80–95 % 的峰值功耗。 其他部件——内存、SSD、主板、风扇——加起来只是个零头。配电源时,直接按 CPU TDP + GPU TDP 来算,再额外留出 100 W 给其他小件就够了。

- 空载和满载之间的差距非常夸张,特别是 GPU。 比如 RTX 4090 空载时只有大约 18 W,而满载能飙到 450 W——整整 25 倍的波动。这就是为什么风扇噪音会随着负载变化,也是为什么给 GPU 降压比给 CPU 降压效果更显著的原因。

一个小技巧:如果系统在运行某些游戏场景或渲染任务时频繁重启,问题很可能不是电源的平均功率不足,而是它的瞬态响应能力不够。现代 GPU 在毫秒级别内可能会瞬间冲到 TDP 的 1.3–1.5 倍,这种尖峰电流会让那些“刚好够用”的电源触发过流保护,导致系统重启。

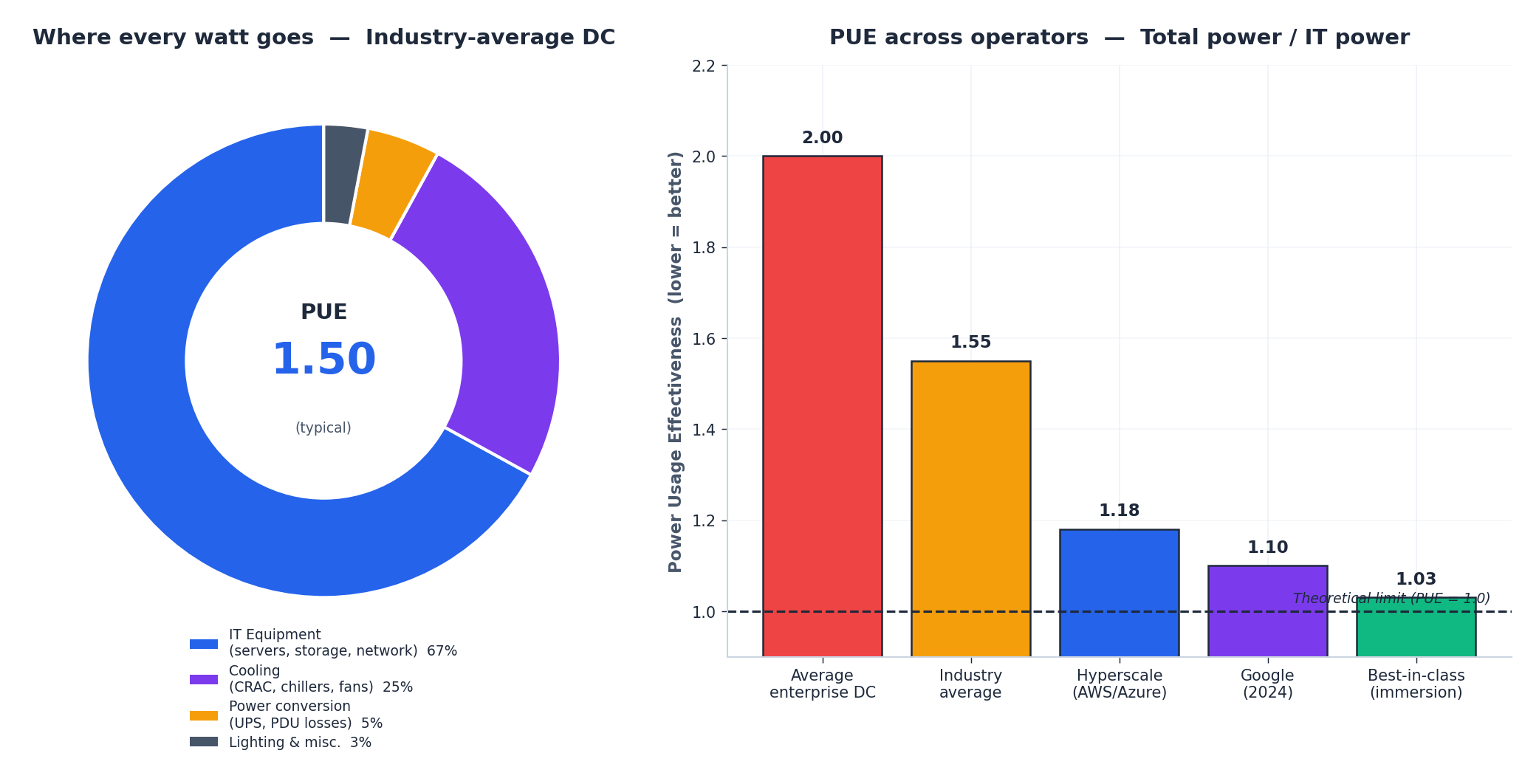

第九部分:数据中心 PUE——每一瓦电都用在了哪里?#

$$ \text{PUE} = \frac{\text{设施总功耗}}{\text{IT 设备功耗}} $$PUE = 1.0 是理论上的完美值:电网的每一度电都用来干计算的活儿。但现实情况是这样的:

一个典型 PUE = 1.5 的数据中心,电力分配大致如下:

- 67 % 给 IT 设备——服务器、存储设备、网络设备。这才是你花钱建数据中心的原因。

- 25 % 给制冷系统——冷水机组、CRAC(计算机房空调)、风扇。热负荷越大,这部分占比越高。

- 5 % 被配电系统吃掉了——UPS、PDU 和变压器的损耗。

- 3 % 分给了照明、安保和其他建筑用电。

超大规模数据中心的玩家已经把 PUE 压得非常低了。Google 2024 年全机队的 12 个月滚动平均 PUE 达到了 1.10,而一些顶尖设施(比如采用浸没式冷却、不依赖冷水机的)甚至接近 1.03。这些进步主要得益于以下几点:

- 提高进风温度——冷通道的温度从 18 °C 提升到 27 °C,制冷需求直接减半。

- 自然冷却——大部分时间利用室外空气(北方地区甚至用海水),避免使用压缩机制冷。

- 优化气流管理——冷热通道隔离、盲板封堵空位、地板格栅密封,减少热量混杂。

- 高电压配电——直接用 415 V 三相电送到机柜,比传统的 208 V 少了一次转换,损耗更低。

- 液冷和浸没式冷却——对于高密度 GPU 机柜,彻底抛弃空气作为换热介质,改用液体冷却。

这也解释了为什么超大规模数据中心选址如此讲究:冰岛、俄勒冈州、瑞典北部等地,全年大部分时间都可以实现几乎“免费”的自然冷却。

第十部分:UPS——为系统保驾护航#

电网稍有波动,哪怕只是短短 30 毫秒的闪断,也可能导致未受保护的服务器瞬间宕机。而 UPS(不间断电源)正是在这关键时刻发挥作用的“救火队员”,它能够在主电网断电和柴油发电机启动之间提供稳定的电力过渡。

三种常见的 UPS 拓扑结构#

- 后备式(Standby) ——平时设备直接由市电供电,当出现电压骤降或断电时,继电器会切换到逆变器供电。切换时间大约在 4 到 10 毫秒之间。这种方案成本较低,适合家庭单台电脑使用。

- 在线互动式(Line-Interactive) ——在后备式的基础上增加了一个自耦变压器,能够在不依赖电池的情况下调节中等程度的电压波动(如电压过高或过低)。切换时间缩短至 2 到 4 毫秒,广泛应用于小型服务器机房。

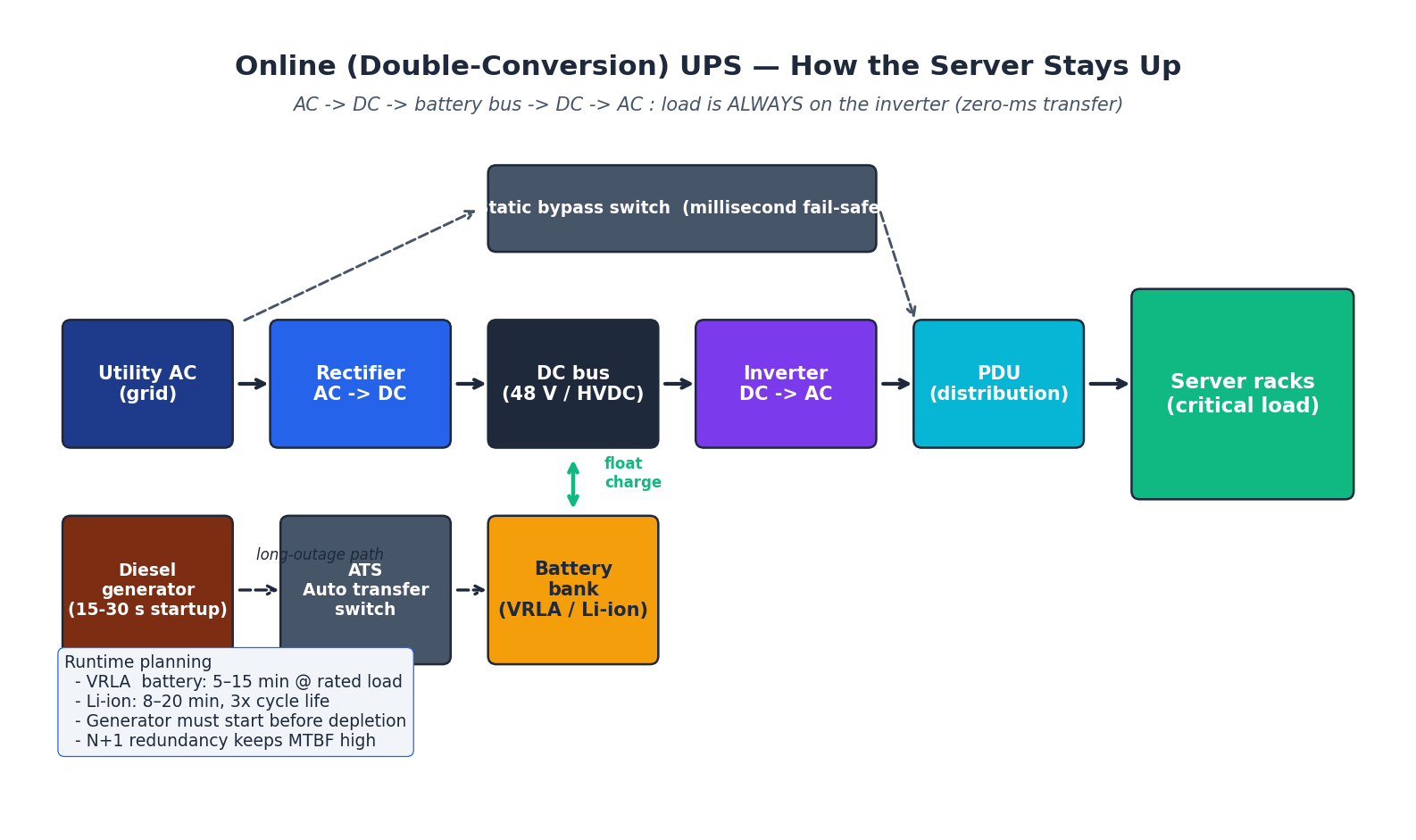

- 在线双变换式(Online Double-Conversion) ——负载始终由逆变器供电,电力路径为:交流电 → 直流电(整流)→ 直流母线 → 直流电 → 交流电(逆变)。电池则始终保持在直流母线上浮充。切换时间为 0 毫秒,负载完全感知不到电网中断的发生。这是数据中心的标准配置。

真实数据中心的完整供电链路#

- 市电 从电网接入(如果特别谨慎,还会从另一座变电站拉一路备用电源)。

- ATS(自动切换开关)位于市电和发电机之间,负责在不同电源间切换。

- 当 ATS 检测到市电中断时,柴油发电机 会在 10 到 30 秒内启动并接管供电。

- 在这短暂的 10 到 30 秒内,在线式 UPS 负责支撑负载。现代设计大多采用锂电池,其循环寿命是传统 VRLA 电池的 3 倍,且占地面积仅为后者的一半。

- PDU(电源分配单元)将高电流主干线分成多个支路,为每个机柜提供独立电路。

- 服务器电源 通常配置两套,分别接入独立的供电回路(A 路和 B 路),以确保即使某一路 UPS 或 PDU 出现故障,也不会导致整个机柜宕机。

正因如此,超大规模数据中心会设计多层级的 N+1 冗余:市电、发电机、UPS、PDU 和服务器电源。任意一层的单点故障对用户来说都是无感知的;即使是同一层出现两个同时故障,系统也能扛住。真正导致全站瘫痪的情况,几乎总是因为故障在不同层级间级联扩散——而这种情况绝大多数是人为操作失误造成的,而非设备本身的问题。

电池续航时间有多长?#

UPS 的续航时间主要取决于 负载大小 和 电池容量,而不是 UPS 的标称功率:

- 如果一台 5 kVA 的 UPS 在满载(5 kW)情况下使用内置的小容量电池,通常只能支撑 5 到 10 分钟。

- 同样的设备在半载的情况下,续航时间会延长到大约 25 分钟左右,这是因为电池放电的特性是非线性的。

- 如果配备了外置电池柜,续航时间可以进一步延长到数小时。不过,在实际应用中,外置电池的容量通常只会设计到“足够发电机完成启动并稳定运行”的程度——一般以 15 分钟为设计目标。

第十一部分:常见硬件故障——分诊指南#

修了十年别人的电脑之后会发现,几乎所有问题都集中在那几种失效模式上。

开机故障排查指南#

| 现象 | 第一步尝试 | 如果无效再试 |

|---|---|---|

| 主机完全不通电 | 检查插座是否有电、电源开关是否打开、24-pin 主供电接口是否插牢 | 用回形针短接 PSU 的绿色线和任意黑线测试电源是否正常工作 |

| 风扇转动但无显示 | 重新插拔内存条——这种方法能解决大约 80% 的类似问题 | 清除 CMOS 设置,逐一测试每根内存条,或者切换到主板集成显卡 |

| 主板发出蜂鸣声 | 查阅主板说明书中的蜂鸣码对照表 | 不同型号的主板蜂鸣码定义可能不同 |

| 启动后立即蓝屏或内核崩溃 | 检查 CPU 温度(可能是散热器未正确安装导致过热) | 使用 MemTest86 测试内存一整晚,并检查启动盘的 SMART 状态 |

| 启动后负载下自动重启 | 电源功率不足或老化,显卡瞬时功耗过高 | 换一个功率更大且已知正常的电源进行测试 |

虽然“重插内存”听起来像是一种玄学操作,但它背后其实有科学依据:温度变化会导致 DIMM 内存条逐渐从插槽中松动,同时金手指表面会因氧化而增加接触电阻。将内存条拔出再重新插入,可以有效擦除氧化层,恢复低阻抗的电气连接。

存储与 GPU#

- SSD 突然卡顿——先检查剩余空间(消费级 SSD 剩余容量低于 10% 时,垃圾回收机制可能会导致性能骤降),确保 TRIM 功能已启用,同时查看 SMART 信息中的“磨损均衡计数”指标。

- 显卡画面异常——通常是过热或供电不稳定导致的。可以尝试重新插拔 PCIe 供电线,或者将显存频率降低 200 MHz 来排查问题。

- 显卡无法识别——可能是插错了 PCIe 插槽(优先使用靠近 CPU 的主 x16 插槽,而非芯片组扩展的副槽)、未连接额外供电线,或者在一些高端机箱中 riser 线缆损坏。

- M.2 NVMe 设备消失——某些主板的 M.2 插槽会与特定 SATA 接口共享带宽,建议查阅主板手册,确认是否存在“共享通道”的限制说明。

网络问题排查#

- 频繁断网 ——检查对端设备是否正常,更换网线试试,或者更新网卡驱动程序。

- Wi-Fi 速度慢 ——尝试从 2.4 GHz 切换到 5 GHz 频段;使用 Wi-Fi 分析工具找到干扰较少的信道;同时留意附近是否有微波炉或蓝牙设备造成的信号干扰。

- 无法获取 DHCP 地址 ——先确认网口指示灯是否亮起,运行

ip addr查看是否存在 APIPA 地址(169.254.x.x),最后可以尝试重启 DHCP 客户端服务。

总结#

这个系列的核心内容,可以用五句话概括:

- 串行任务的性能瓶颈通常是 CPU,而并行任务则卡在 GPU 上,其他硬件的作用本质上是在为它们“打辅助”。

- 内存层级结构(寄存器 → L1/L2/L3 缓存 → DRAM → NVMe → HDD)的延迟差异横跨七个数量级,优秀的代码设计必须充分考虑数据局部性。

- 存储系统的性能不仅要看带宽和 IOPS,还要关注寿命,具体选型完全取决于实际的工作负载。

- 总线(如 PCIe)、接口(如 USB、Thunderbolt)以及主板上的 VRM 模块,直接决定了硬件芯片能否充分发挥其潜力。

- 网络和电源是大多数装机者最容易忽略的两个部分,但它们却常常引发最匪夷所思的故障。

如果只能记住一点,请记住:性能瓶颈几乎从来不会出现在你最初怀疑的地方。 使用工具进行分析和测量,相信数据,而不是盲目依赖规格表。

接下来的深度篇(第六部分)将重新探讨本系列中浅尝辄止的内容,包括缓存一致性协议、NUMA 架构、芯片级虚拟化技术,以及能效优化的前沿问题。