常微分方程(十八):前沿专题与系列总结

系列终章。回顾正在重塑动力学建模的四大前沿——Neural ODE、时滞方程、随机微分方程、分数阶微积分——然后用一张方法选择流程图、一张 ODE-机器学习连接图,把整个 18 章的旅程做一次完整的盘点和送别。

旅程到此结束: 十八章前,我们从一枚下落的苹果启程;今天,我们仍以同样的精神作结——继续将常微分方程(ODE)视为 变化的通用语言,只是如今站在更高的山巅。

本章聚焦三件事:首先,概览四个正在重塑动力系统建模方式的前沿方向——Neural ODE、时滞微分方程、随机微分方程和分数阶微积分;其次,借助一张问题求解流程图与一份章节地图,回顾整个系列的核心脉络;最后,明确揭示你刚刚掌握的经典理论如何与现代机器学习紧密相连——这正是 ODE 在 2025 年最富活力的领域。

我会让本章保持可读性,而非追求百科全书式的完备。每个前沿方向仅强调其 核心直觉 与 为何重要;若想深入细节,请查阅文末参考文献。

总结#

- Neural ODE:打通深度学习与连续动力学

- 时滞微分方程:系统自带记忆功能

- 随机微分方程(SDE):噪声成为核心要素

- 分数阶导数与反常扩散

- ODE-ML 深层联系:PINN、扩散模型、最优传输

- 18 章概念图与方法选择流程

- 后续学习路线图

前置知识#

本章内容建立在整个系列的基础之上。若你已熟悉 第 1–17 章 ,理解会更顺畅——但既然你已走到这里,就说明你已准备就绪。

整门课在一张图里#

在跨出经典世界之前,先回望我们共同构建的知识大厦。

请将它看作一段旅程,而非等级分明的层级结构:

- 基础(第 1–5 章) —— 从单个方程出发,进入线性理论,再延伸至变换与级数方法。

- 动力学与非线性(第 6–10 章) —— 探索耦合系统、相图、稳定性、混沌与分岔。

- 计算(第 11–13 章) —— 掌握数值方法、边值问题,并搭建通往偏微分方程(PDE)的桥梁。

- 应用(第 14–17 章) —— 覆盖流行病学、生态学、控制理论、物理与工程。

- 前沿(第 18 章) —— 踏入当今研究最活跃的疆域。

Neural ODE ── 深度即时间#

2018 年,Chen、Rubanova、Bettencourt 与 Duvenaud 在 NeurIPS 发表的《Neural Ordinary Differential Equations》一文,让深度学习从业者纷纷翻开 ODE 教科书。其思路之简洁,近乎“不公平”地优雅。

$$h_{t+1} = h_t + f(h_t,\; \theta_t).$$ $$\frac{d h(t)}{dt} = f\!\bigl(h(t),\; t,\; \theta\bigr).$$这便是一个可学习的 ODE。前向传播变成求解 ODE 的过程;网络拥有了 自适应深度;而借助 伴随方法(adjoint method),反向传播的内存开销可降至 $O(1)$ ——这与你在第 16 章 控制理论中遇到的庞特里亚金(Pontryagin)方程如出一辙。

| |

Neural ODE 天然适用于处理 不规则采样的时间序列(如医疗记录、传感器日志),并催生了用于密度建模的 连续归一化流(Continuous Normalizing Flows)。从哲学角度看,它堪称机器学习重新发现微积分传统的典范——积分器不再仅仅是求解工具,它本身就成了模型。

时滞微分方程 ── 带“记忆”的系统#

许多真实系统不仅响应当前状态,还依赖过去某一时刻的状态。例如,配送车队对今日价格变动的反应,可能取决于两周前的订单积压;今日的红细胞数量反映的是数日前骨髓发出的信号;激光腔反馈的光,则是皮秒前发射的。

$$\dot x(t) = f\bigl(x(t),\; x(t - \tau)\bigr).$$此时状态空间变为 无限维:初始条件不再是单个数值,而是整段历史 $\{x(s) : s \in [t-\tau, t]\}$ 。

Hutchinson 方程#

$$\dot N(t) = r N(t)\,\Bigl(1 - \frac{N(t-\tau)}{K}\Bigr).$$当无延迟($\tau = 0$ )时,它退化为平滑的 Verhulst S 形曲线;但引入延迟后,系统可能失稳并产生极限环。具体而言,当 $r\tau > \pi/2$ 时,平衡点会通过 Hopf 分岔(见第 10 章 )失去稳定性,从而引发振荡。

| |

Mackey-Glass 方程 在 $\tau = 17$ 时可产生低维混沌——一个仅由单一时滞反馈环生成的奇异吸引子。时滞现象广泛存在于流行病学(潜伏期)、经济学(生产周期)以及任何存在传输延迟的控制回路中。

随机微分方程 ── 噪声成为主角#

其中 $W_t$ 是标准维纳过程(即布朗运动),$dW_t$ 是形式上的高斯增量,其方差为 $dt$ 。

两个经典例子:

$$ dS = \mu S\,dt + \sigma S\,dW, \qquad S(t) = S_0\exp\!\Bigl[(\mu - \tfrac12\sigma^2)\,t + \sigma W(t)\Bigr]. $$ $$ dX = \theta(\mu - X)\,dt + \sigma\,dW. $$ $$\partial_t \rho = -\partial_x(f\rho) + \tfrac12\,\partial_x^2(g^2\rho).$$由此,随机世界与确定性世界被紧密联系:个体轨迹的 SDE 对应群体分布的 PDE。

| |

SDE 构成了数理金融、统计物理与神经科学的基石,同时也是——我们稍后会看到——现代生成式人工智能的核心基础。

分数阶微分方程 ── 阶数为 0.7 的导数#

$${}^C\!D^\alpha f(t) \;=\; \frac{1}{\Gamma(1-\alpha)}\int_0^t \frac{f'(\tau)}{(t-\tau)^\alpha}\,d\tau.$$ $${}^C\!D^\alpha y(t) = -\lambda\,y(t)$$ $$y(t) = E_\alpha\!\bigl(-\lambda t^\alpha\bigr) = \sum_{k=0}^\infty \frac{(-\lambda t^\alpha)^k}{\Gamma(1 + k\alpha)}.$$当 $\alpha = 1$ 时,它退化为熟悉的指数衰减 $e^{-\lambda t}$ ;而当 $\alpha < 1$ 时,初期衰减比指数更快,但长期尾部呈现幂律行为 $\sim t^{-\alpha}/\Gamma(1-\alpha)$ ——系统“记得”自己的历史。

正是这种记忆特性,使分数阶 ODE 成为以下现象的天然语言:

- 粘弹性材料 —— 其蠕变行为既非胡克弹性也非牛顿粘性。

- 反常扩散 —— 均方位移满足 $\langle x^2\rangle \propto t^\alpha$ 且 $\alpha \neq 1$ (见于多孔介质、生物细胞,甚至某些尺度下的金融收益率)。

- 幂律松弛 —— 出现在电介质、玻璃及生物组织中。

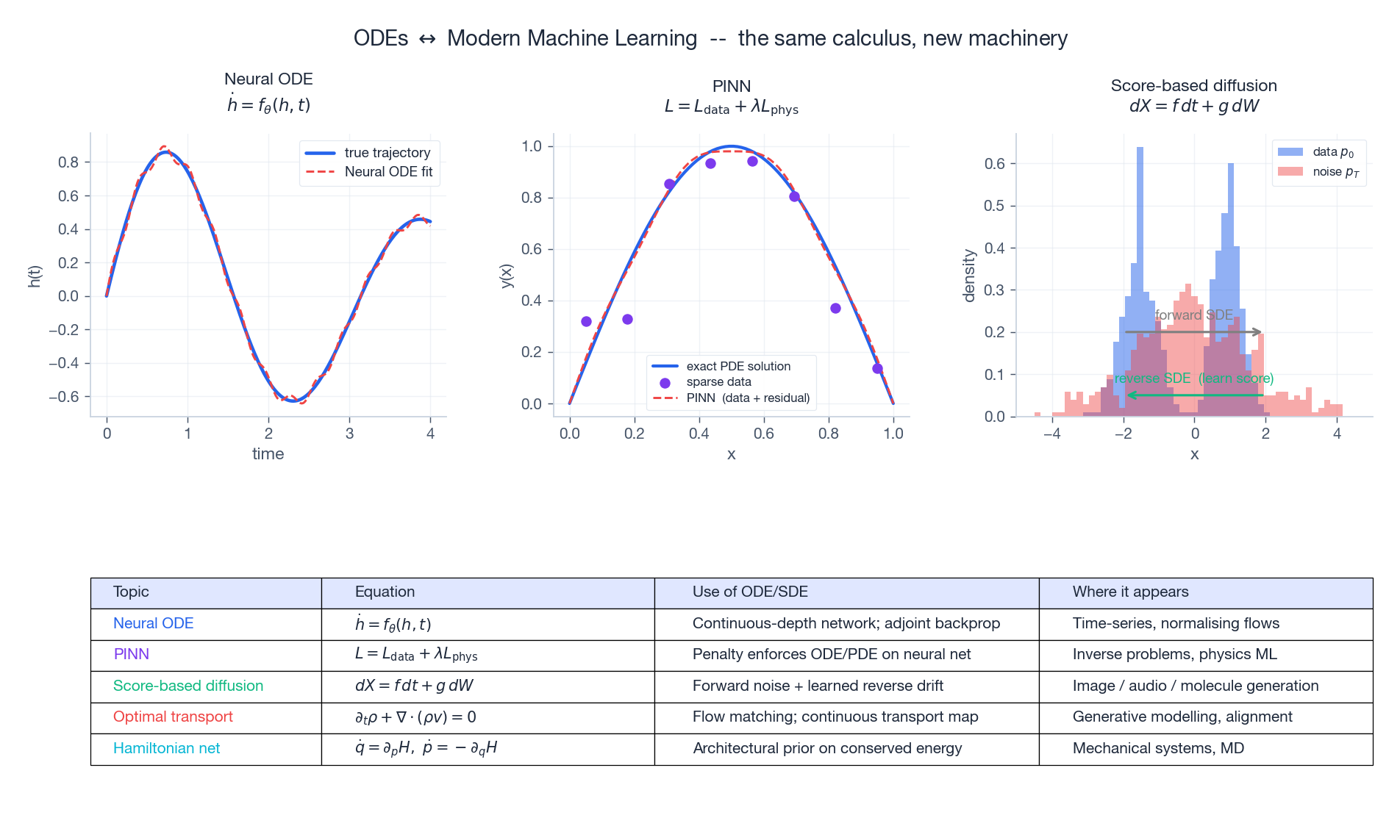

ODE-ML 连接 ── 不只是一时风潮#

引言已提及 Neural ODE 与 PINN,但更深层的图景在于:ODE 与 SDE 正是现代生成模型的心脏。

有三点值得特别关注:

- 基于得分的扩散模型(Stable Diffusion 等的核心)本质上是带有可学习漂移项的 SDE。图像生成 = 沿时间反向求解随机 ODE。

- 连续归一化流 通过 ODE 变换基础概率密度;变量变换的雅可比行列式由 $\partial_t \log p = -\nabla \cdot f$ 给出。

- 最优传输 / 流匹配(flow matching)方法训练一个向量场,沿直线轨迹将一个分布形变为另一个——ODE 成为生成式 AI 的几何骨架。

一个实用结论:2025 年的严肃 ML 实践者 必须 能自如阅读 $dX = f\,dt + g\,dW$ 这类表达式。

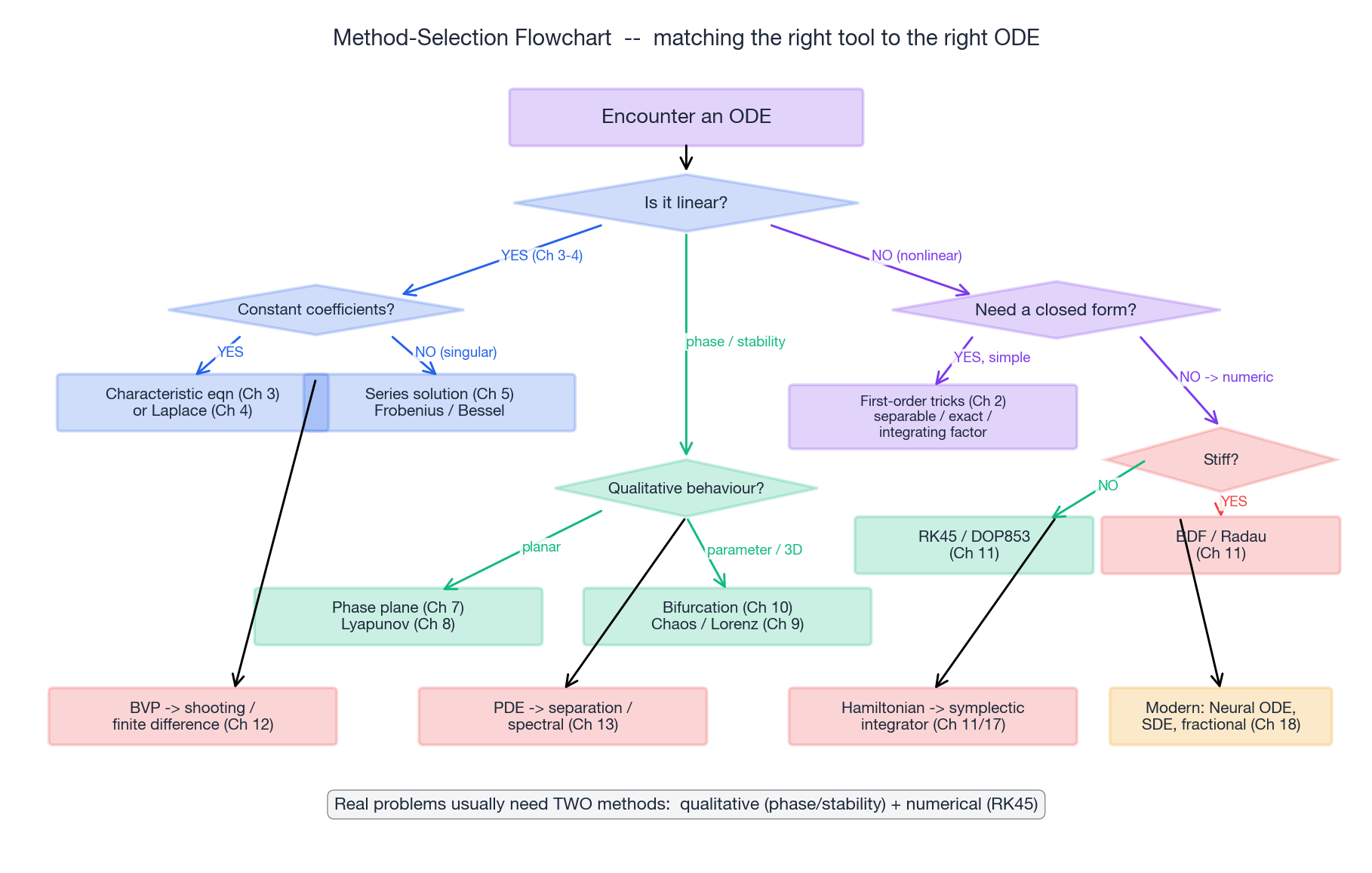

方法选择流程图#

面对任何一个摆在你面前的 ODE,下面这张决策树可助你快速选择策略。

流程图无法涵盖的几条实战建议:

- 务必先检查刚性。若对刚性系统使用 RK45,求解器会默默采取海量小步长,效率极低。一旦观察到快速暂态,应改用 BDF 或 Radau 方法。

- 对于哈密顿(Hamiltonian)系统,优先选用辛积分器(如 Verlet)——它们能在长时间尺度上近似守恒能量,而通用 RK 方法则会产生能量漂移。

- 边值问题(BVP) 推荐使用 SciPy 的

solve_bvp;若问题刚性较强,可能需要配置法(collocation)。 - 偏微分方程(PDE) 通常先通过“线法”(method of lines)离散空间变量,再将时间维度交由 ODE 求解器处理。

18 章一览表#

| 章节 | 主题 | 你现在能做的事 |

|---|---|---|

| 1–2 | 一阶方程 | 识别并求解可分离、线性、全微分、Bernoulli 类型 |

| 3–4 | 高阶线性 & 拉氏变换 | 求解常系数 LTI 系统的解析解 |

| 5 | 级数 & 特殊函数 | 在奇点附近使用 Frobenius 方法;掌握 Bessel、Legendre、Hermite 函数 |

| 6–7 | 方程组 & 相平面 | 计算矩阵指数;分类平衡点类型 |

| 8–10 | 稳定性、混沌、分岔 | 构造 Lyapunov 函数;理解 Lorenz 吸引子;分析 Hopf 与 pitchfork 分岔 |

| 11–13 | 数值、BVP、PDE | 应用 RK4、BDF、打靶法、有限差分 |

| 14–15 | 生物应用 | 建立 SIR 模型(含 $R_0$ )、Lotka-Volterra 捕食-竞争模型 |

| 16–17 | 工程应用 | 设计 PID/LQR 控制器;分析单摆、RLC 电路、开普勒轨道、振动系统 |

| 18 | 前沿 | 理解 Neural ODE、DDE、SDE、分数阶、PINN、扩散模型 |

若你完整阅读了全部十八章,那么你所掌握的内容已远超一门本科常微分方程课程,涵盖了非线性动力学的研究生专题,并触及了与现代机器学习的交叉前沿——如此广度,在常规教学中实属罕见。

接下来怎么走#

选目标,而非盲目选书。以下是五个清晰的进阶方向及其对应资源:

| 目标 | 推荐读物 | 理由 |

|---|---|---|

| 打牢经典理论 | Hirsch, Smale & Devaney, Differential Equations, Dynamical Systems | 几何视角最清晰简洁 |

| 提升数值能力 | Hairer & Wanner, Solving ODEs (vol 1+2) | 数值 ODE 领域的“圣经” |

| 深入非线性动力学 | Strogatz, Nonlinear Dynamics and Chaos | 直觉优先,文笔极佳 |

| 迈向 PDE | Evans, Partial Differential Equations | 研究生标准教材 |

| 对接 ML | Kidger, On Neural Differential Equations(免费博士论文) | 内容现代、代码丰富、讲解透彻 |

软件方面:Python 用户可用 scipy.integrate;Julia 用户推荐 DifferentialEquations.jl(业界顶尖);JAX 用户可选 diffrax(支持自动微分);PyTorch 用户则可用 torchdiffeq。

系列旅程#

每个标签都值得驻足回味。起源教会我们将 $F = ma$ 写成方程;一阶提供了四种手算技巧,竟能解决大量实际问题;线性理论与拉普拉斯变换将 LTI 系统的高阶行为转化为代数与特征多项式;级数则打开了特殊函数的大门,让我们超越多项式与指数函数的局限。

方程组将视角推广至向量形式;相平面以几何替代解析解;稳定性与混沌揭示了即使预测失效,系统仍可蕴含优美结构;分岔则展示了定性行为如何随参数连续演变。

数值方法传授工程实现之道:RK4、BDF、辛积分;边值问题与偏微分方程将视野拓展至空间维度;而应用章节则通过流行病学、生态学、控制、力学、电子学与流体力学,反复验证了这套“五步语法”的普适性。

最终,在终章,这套工具变得现代:Neural ODE 将积分器本身变为可学习模型;SDE 赋予噪声主角地位;分数阶导数填补了整数阶之间的空白;PINN 与扩散模型则将 ODE 深深嵌入当代人工智能的引擎之中。

总结#

微分方程是变化的法则: 它描述物体如何下落、种群如何增长、电流如何振荡、国家如何达成群体免疫、神经网络如何学习、宇宙如何膨胀。世间一切关于动态演化的正式陈述,归根结底都是这个家族中的某个方程。

你已走过十八章的旅程,邂逅了 Newton、Laplace、Lyapunov、Lorenz、Lotka、Volterra、Bode、Riccati,以及 Chen-Rubanova-Bettencourt-Duvenaud。你或许曾用 Python 画出一幅干净利落的相图,为之惊喜;也可能在看到一扇摆动的门或一个卡顿的应用时,下意识地在脑中写下它的微分方程。

若真如此,那么我们的目标已然达成。数学并非一堆需死记硬背的公式,而是一种 看见 的习惯。ODE 比几乎所有其他学科都更能锤炼这种习惯,因为它正是严谨逻辑与现实世界交汇之处。

去使用它吧。预测、设计、控制、学习。

旅程到此结束——而真正的实践,此刻才刚刚开始。

感谢阅读。

总结#

十八章下来,我们从最简单的"咖啡会凉"出发,一路走到混沌、分岔、控制、PDE 引论。如果只让我留三句话给你:

- ODE 是把"局部变化率"积分成"全局轨迹"的工具——所有解法(解析的、数值的、定性的)本质都是在做这一步积分。

- 线性是地基,但非线性才是真实——叠加原理给了我们解析解的奢侈,但极限环、混沌、分岔只活在非线性里。

- 一个 ODE 的物理意义比它的解析形式重要——同一个 SIR 方程在 COVID 早期可以救命,写在纸上只是几个符号。

接下来你可以选择往哪走:

- 想做物理建模:去读 PDE(波、热、Schrödinger)、Hamilton 力学、规范场论。

- 想做工程:深入控制理论(最优控制、鲁棒控制)、信号处理、刚性数值积分。

- 想做生物/经济:随机微分方程(SDE)、Agent-based 建模、博弈动力学。

- 想做 ML:神经 ODE、normalizing flows、连续时间生成模型——它们都是把 ODE 当成可微计算图。

ODE 不是一门学完就丢的课。它是看世界的一种方式——任何"东西在变"的现象,背后大概率有一个 ODE 在等着你写出来。

参考文献#

- Chen, R. T. Q., Rubanova, Y., Bettencourt, J., Duvenaud, D. (2018). “Neural Ordinary Differential Equations.” NeurIPS.

- Kidger, P. (2021). On Neural Differential Equations. PhD thesis, Oxford.

- Kloeden, P. E., Platen, E. (1992). Numerical Solution of Stochastic Differential Equations. Springer.

- Diethelm, K. (2010). The Analysis of Fractional Differential Equations. Springer.

- Hairer, E., Lubich, C., Wanner, G. (2006). Geometric Numerical Integration. Springer.

- Smith, H. (2010). An Introduction to Delay Differential Equations. Springer.

- Song, Y., Ermon, S. (2020). “Generative Modeling by Estimating Gradients of the Data Distribution.” NeurIPS.

ODE 入门精讲 18 篇

- 01 常微分方程(一):微分方程的起源与直觉

- 02 常微分方程(二):一阶微分方程的求解方法

- 03 常微分方程(三):高阶线性微分方程

- 04 常微分方程(四):拉普拉斯变换

- 05 常微分方程(五):级数解法与特殊函数

- 06 常微分方程(六):线性微分方程组

- 07 常微分方程(七):稳定性理论

- 08 常微分方程(八):非线性系统与相图

- 09 常微分方程(九):混沌理论与洛伦兹系统

- 10 常微分方程(十):分岔理论

- 11 常微分方程(十一):数值方法

- 12 常微分方程(十二):边值问题

- 13 常微分方程(十三):偏微分方程引论

- 14 常微分方程(十四):传染病模型与流行病学

- 15 常微分方程(十五):种群动力学

- 16 常微分方程(十六):控制理论基础

- 17 常微分方程(十七):物理与工程应用

- 18 常微分方程(十八):前沿专题与系列总结 当前