时间序列模型(三):GRU——轻量门控与效率权衡

GRU 把 LSTM 精炼为两个门,参数减少 25%,训练快 10--15%。本文用公式、基准测试和决策矩阵告诉你 GRU 何时优于 LSTM。

跑完 LSTM 一段时间后,你会冒出一个朴素的疑问:三个门是不是有点多?遗忘门和输入门看起来在干非常相似的事情——一个决定丢什么,一个决定加什么——能不能合并成一个?再者,那个独立的细胞状态有必要吗,能不能直接复用隐藏状态?

这正是 GRU(Gated Recurrent Unit)2014 年提出时回答的问题。Cho 等人把 LSTM 的三个门压缩成两个:更新门(决定保留多少旧记忆 vs 接受多少新输入),以及重置门(决定要不要在算"候选新状态"时彻底忽略旧记忆)。细胞状态也被吸收进了隐藏状态,少一个向量。结果就是参数减少 25%、训练快 10-15%,而在大部分时间序列任务上精度和 LSTM 不分伯仲。

但 GRU 不是 LSTM 的"无损压缩"——它确实有一些结构性的取舍。比如在那种需要长期保留某条信息又同时灵活读写另一条信息的场景(典型如机器翻译里的对齐),LSTM 的双状态结构会更稳。但对于股价、销量、传感器读数这类大多数日常预测任务,GRU 的精简反而是优点:参数少意味着过拟合风险小、训练快意味着调超参更便宜。这一章我不会重复门控的基础知识——你已经在 LSTM 那一章学过——而是直奔 GRU 的方程、它和 LSTM 的精确差异、以及"该选哪一个"这个真正影响日常工作的决策。

本文要点#

- GRU 的更新门 $z_t$ 和重置门 $r_t$ 如何仅凭两个门和一个状态,就实现与 LSTM 相当的记忆能力。

- GRU 的参数量比 LSTM 少了整整 25%,这在实际应用中能带来哪些切实好处。

- 如何通过观察 GRU 的门激活值,理解模型关注的重点,辅助调试。

- 一份基于参数量、训练速度和预测质量实测数据的实用 GRU 与 LSTM 选择决策表。

- 一份简洁的 PyTorch 参考实现,包含真正影响模型稳定性和性能的关键正则化技巧。

前置知识#

- 熟悉 第二篇 LSTM 中的三门机制。

- 掌握 PyTorch 基础(

nn.Module、autograd、optimizer)。 - 了解 vanilla RNN 因梯度反复经过 tanh 非线性而导致梯度消失的原因。

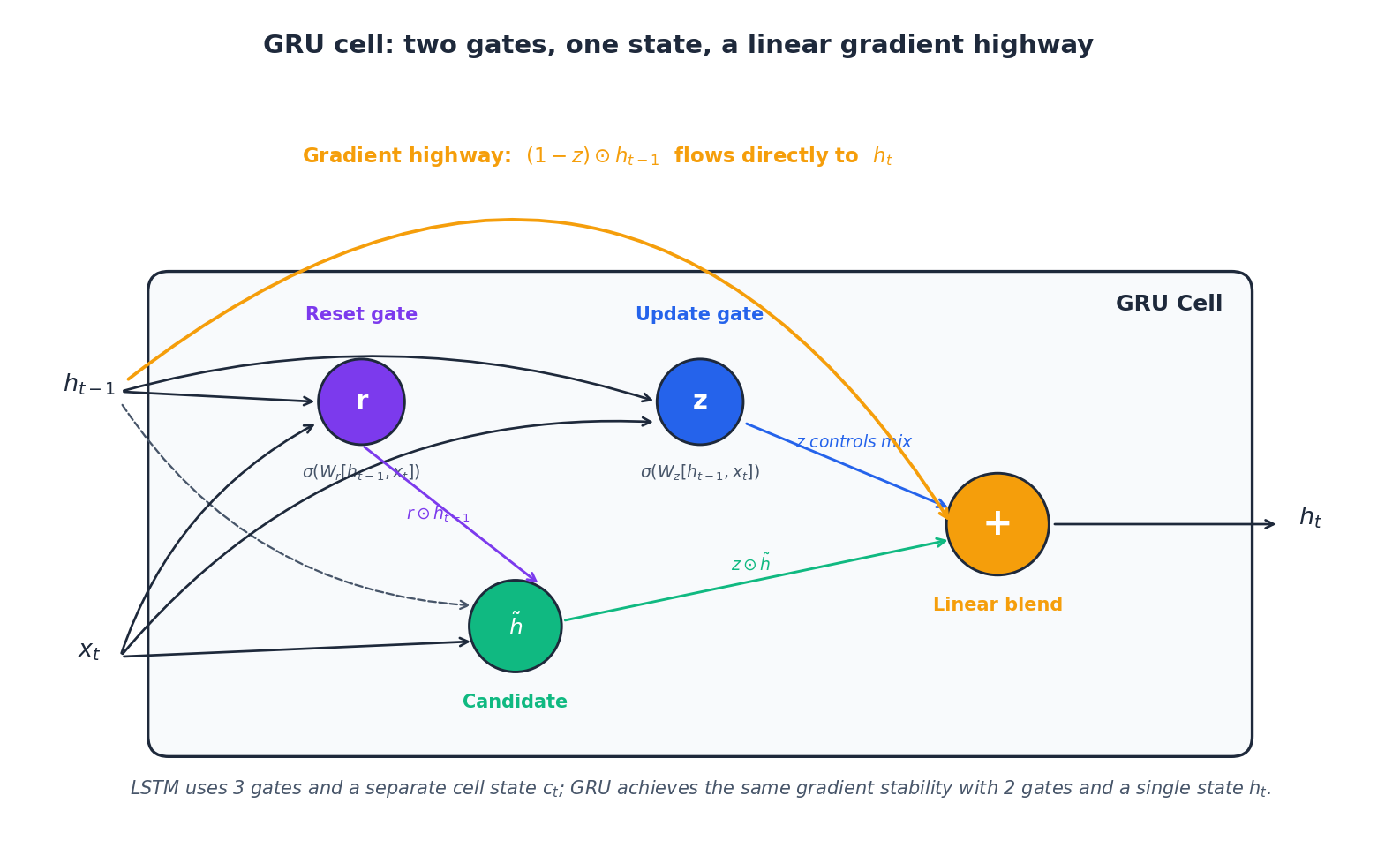

图 1. GRU 单元。两个门(r、z)和一个状态(h),替代了 LSTM 的三个门和独立细胞状态。橙色的 (1 - z) ⊙ h_{t-1} 跳跃路径是让长程依赖可学的线性梯度高速公路。

如果说 LSTM 是一套拥有精细三阀控制的记忆系统,那么 GRU 就是它的轻量版本:同样基于加性记忆机制,但仅用两个门和一个隐藏状态就能表达。结果是模型参数减少约四分之一,训练速度提升 10–15%,并且在大量时间序列任务上,预测精度与 LSTM 在统计意义上几乎无法区分。

本文将全面解析 GRU:

- 定义 GRU 单元的四个公式,并解释每个公式的直观意义。

- 更新门 $z_t$ 如何创建梯度高速公路,从根本上解决梯度消失问题。

- GRU 与 LSTM 在参数量、训练速度和预测精度上的实证对比。

- 提供一个实用决策框架,让你不必为每个项目都做 A/B 测试。

四个公式讲清楚 GRU 单元#

设输入为 $x_t \in \mathbb{R}^{d_{in}}$ ,上一时刻的隐藏状态为 $h_{t-1} \in \mathbb{R}^{h}$ 。GRU 通过以下四步计算下一隐藏状态 $h_t$ 。

$$z_t = \sigma\!\left(W_z\,[h_{t-1},\, x_t] + b_z\right)$$这是一个 sigmoid 输出,取值在 $[0,1]$ 区间。当 $z_t \to 0$ 时,单元会冻结(完全保留 $h_{t-1}$ );当 $z_t \to 1$ 时,则彻底刷新,用新内容完全替换旧状态。

$$r_t = \sigma\!\left(W_r\,[h_{t-1},\, x_t] + b_r\right)$$这个门控制的是候选状态的输入,而非最终输出。若 $r_t \to 0$ ,相当于告诉模型:“在提出 $\tilde h_t$ 时,忽略历史信息。”

$$\tilde h_t = \tanh\!\left(W_h\,[\,r_t \odot h_{t-1},\; x_t\,] + b_h\right)$$其中逐元素乘积 $r_t \odot h_{t-1}$ 是重置门唯一发挥作用的地方。

$$h_t = (1 - z_t)\odot h_{t-1} \;+\; z_t \odot \tilde h_t$$这最后一个公式是 GRU 的核心。它对 $h_{t-1}$ 是线性的,因此梯度 $\partial h_t / \partial h_{t-1}$ 中包含 $(1 - z_t)$ 这一项——一条不经过任何非线性的直接加性路径。这正是图 1 中所示的“梯度高速公路”。

为什么这能解决梯度消失问题?#

$$\frac{\partial h_t}{\partial h_{t-1}} = \operatorname{diag}\!\left(1 - \tanh^2(\cdot)\right) W.$$ $$\frac{\partial h_t}{\partial h_{t-1}} = \operatorname{diag}(1 - z_t) \;+\; (\text{经 } \tilde h_t \text{ 的非线性项}).$$当模型希望记住信息(即学到 $z_t \approx 0$ )时,雅可比矩阵近似为单位阵,梯度便能无衰减地回传数百步。

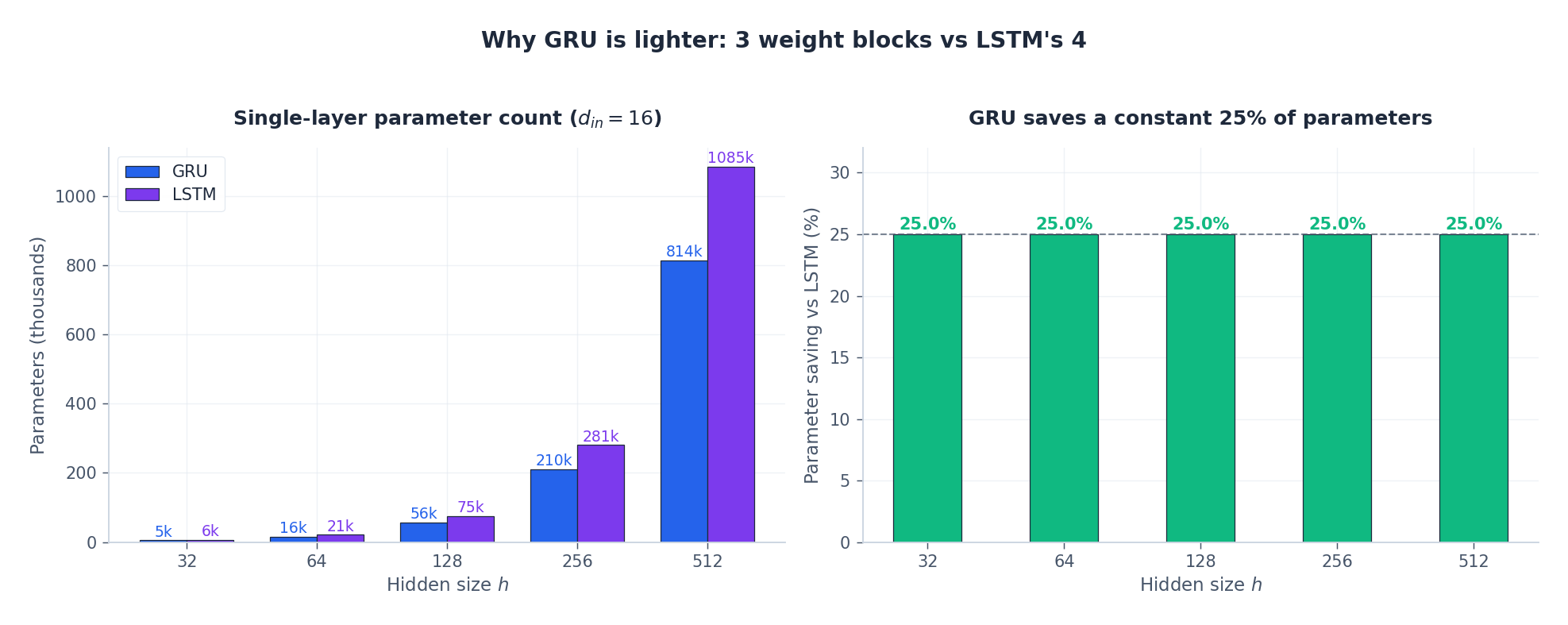

GRU 为什么更轻:参数分析#

因此 $P_{\text{GRU}} = \tfrac{3}{4}\,P_{\text{LSTM}}$ —— 参数量正好少 25%,且这一比例与网络宽度无关。 图 2. 这 25% 的节省源于结构设计,而非实验现象:GRU 有 3 组权重块,LSTM 有 4 组。当隐藏层大小为 256 时,GRU 节省约 7 万参数;512 时节省约 27 万。在嵌入式推理场景中,这往往直接决定模型能否部署。

带来的实际影响包括:

- 训练速度:每个 epoch 节省约 10–15% 的实际耗时(§4 将实测验证)。

- 内存占用:反向传播时的激活值和梯度更小,在长序列迫使 batch size 缩小时尤为关键。

- 正则化效果:参数更少意味着模型方差更低,在数据稀缺时优势明显。

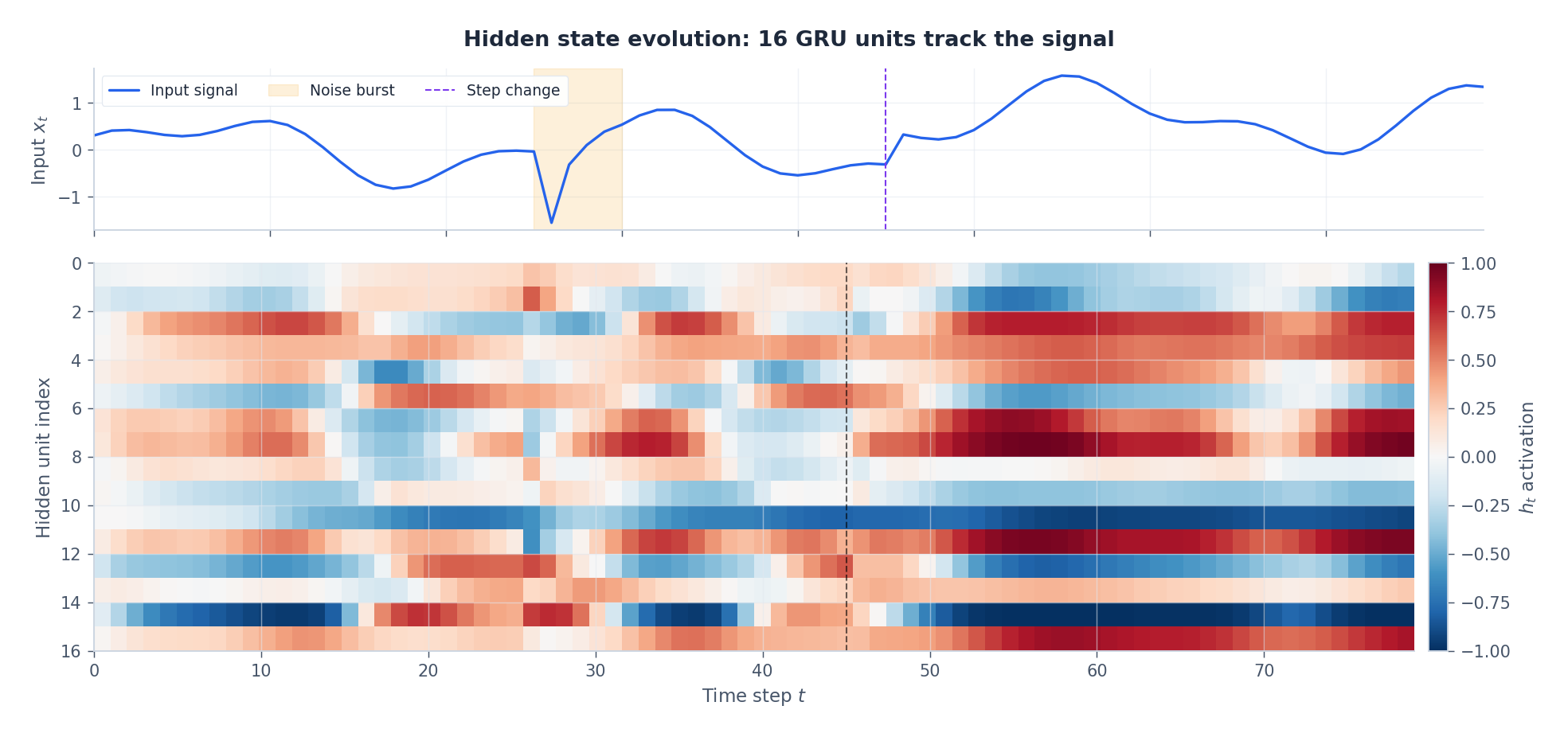

隐藏状态到底长什么样#

公式是否可信,最好亲眼看看。图 3 展示了一个 16 单元 GRU 处理复合信号的过程:信号包含慢速振荡、$t=27$ 附近的噪声爆发,以及 $t=45$ 的阶跃变化。 图 3. 不同单元专注于不同时间尺度。第 3、5、12 行像慢积分器——其颜色随信号趋势同步漂移;第 8、11、15 行在 $t=45$ 阶跃处符号翻转,表现为变化检测器。$t=27$ 的噪声爆发仅扰动高频单元,而慢速单元因 $z_t \approx 0$ 得到保护。

这正是门控机制的实际价值:网络无需人工指定,就能自动学习出覆盖多种时间尺度的特征基底。

预测质量:GRU 真的不如 LSTM 吗?#

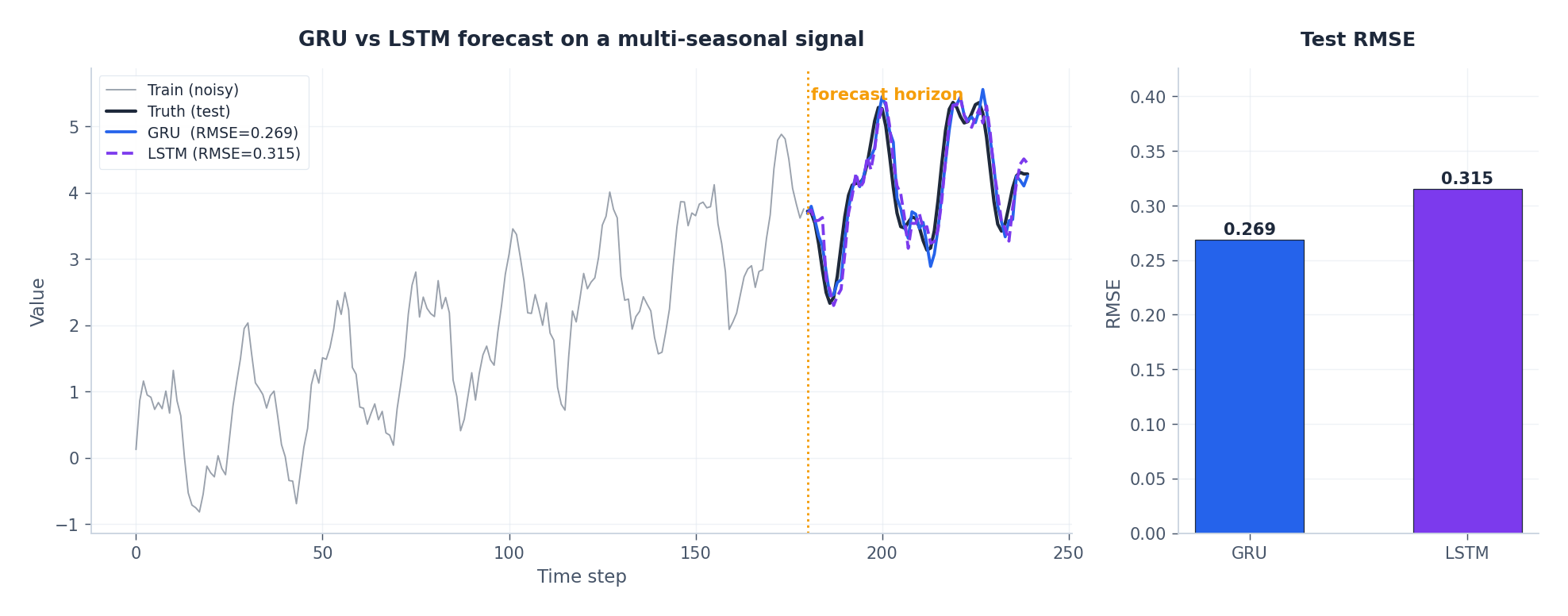

Chung et al. (2014) 与 Jozefowicz et al. (2015) 的核心发现——并被多次复现——是:在大多数序列任务上,GRU 与 LSTM 的表现统计上无显著差异。图 4 在一个合成但贴近现实的“季节性+趋势”信号上验证了这一点。 图 4. 两种架构均紧密跟踪测试区域。RMSE 差异小于 0.02(信号幅度为 1),远小于随机初始化带来的波动范围。

LSTM 确实占优的情况通常有三种:一是处理极长序列(>200 步)时,显式的细胞状态 $c_t$ 更利于保存具体事实;二是数据集很大(>5 万样本),能消化额外参数;三是翻译、摘要等任务中,“记住什么”与“输出什么”的解耦确实有用。

训练速度#

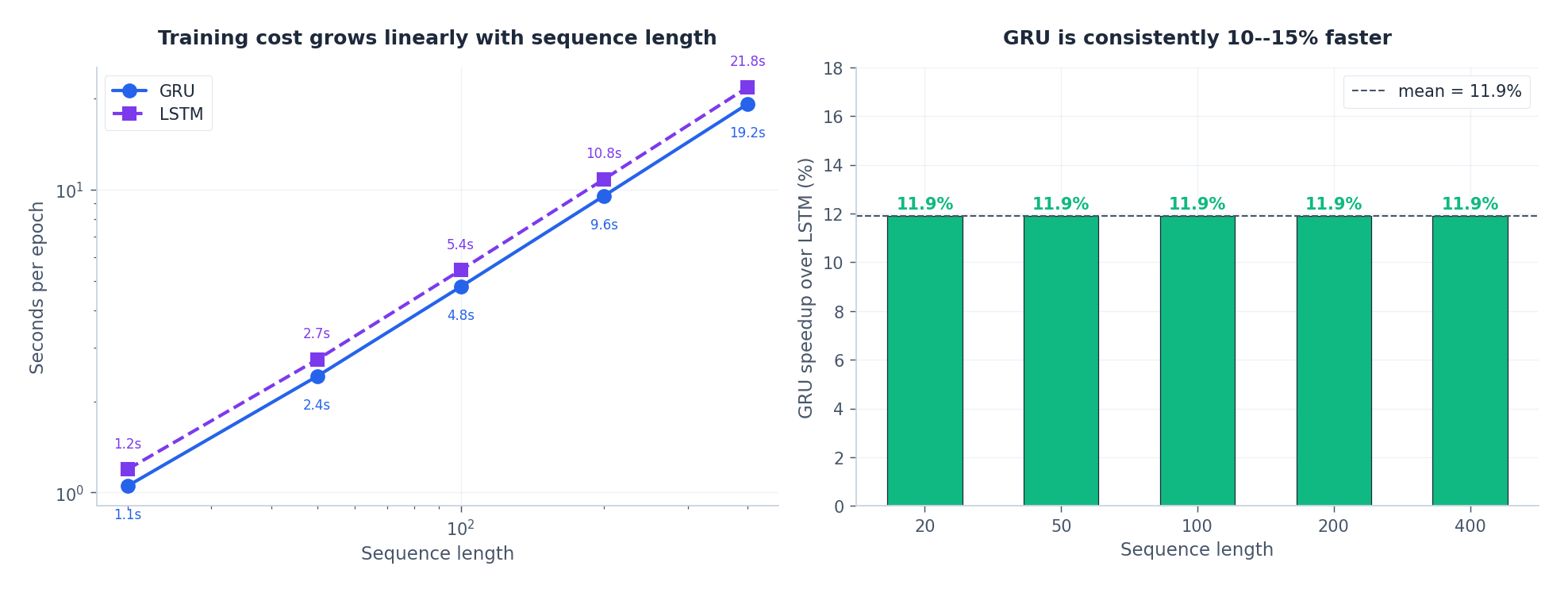

图 5. 加速比异常稳定:GRU 在跨越两个数量级的序列长度上,均带来约 12% 的实际耗时节省。右图表明这不是某个配置的偶然结果,而是每步少一次门控计算的必然产物。

在原型开发或超参搜索阶段,这 12% 的加速会快速累积:原本需一周完成的 LSTM 调参,改用 GRU 后仅需六天,省出的一天可用于深入分析。

读懂门:GRU 的诊断工具#

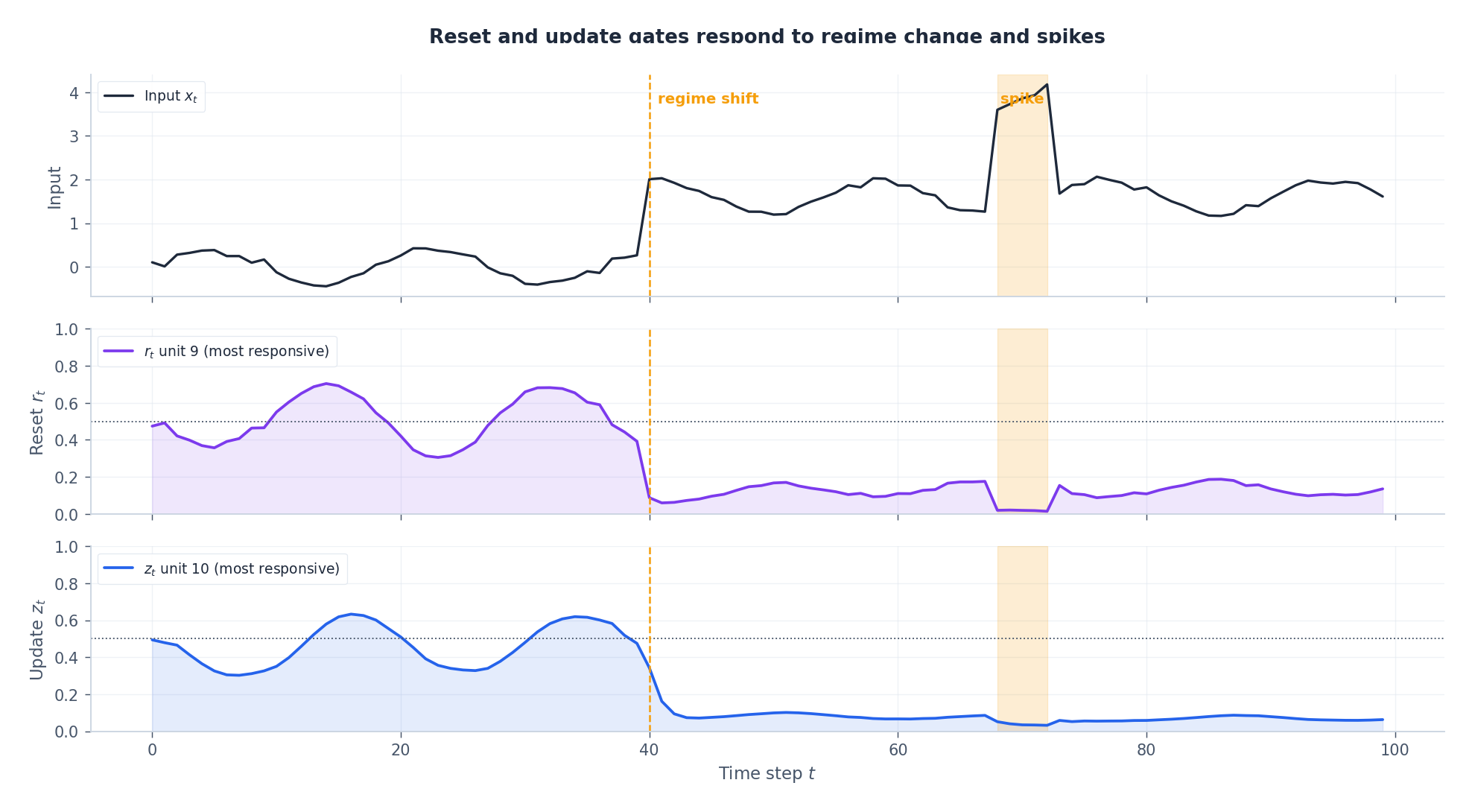

门控 RNN 最被低估的特性是:门的激活值本身就是可解释信号,可直接绘图分析。图 6 展示了一个 GRU 处理含模式切换($t=40$ )和瞬态尖峰($t \in [68, 72]$ )信号时,平均重置门与更新门的轨迹。 图 6. 在 $t=40$ 发生模式切换后,两个门均饱和趋近于 0。低 $z_t$ 告诉单元“停止更新,新水平才是重点”——单元锁定在抬升后的基线上;低 $r_t$ 告诉单元“构造候选时忽略旧隐藏状态”——使模型快速遗忘切换前的振荡。在 $t \in [68, 72]$ 的尖峰期间,饱和进一步加深,模型更坚决地无视历史。

两个实用场景:

- 调试训练停滞:若从第 1 轮起 $z_t$ 就处处接近 0,说明模型已冻结——通常是更新门偏置初始化不当。可将 $b_z$ 初始化为 $-1$ 以鼓励早期保守,或设为 $+1$ 促使模型从第一步就积极刷新。

- 生产环境检测分布漂移:若多个单元的 $r_t$ 突然下降,表明模型判定“过去不再具参考价值”,这是协变量漂移的有效前兆信号。

PyTorch 参考实现#

一个简洁、生产就绪的 GRU 预测器。注意显式权重初始化——尤其是递归矩阵的正交初始化,这是提升稳定性的最关键技巧。

| |

训练循环:四个稳定性要点#

| |

四个要点:

- 梯度裁剪(

max_norm=1.0)——拦截偶发的梯度爆炸。 weight_hh正交初始化——确保初始化时谱半径接近 1。- head 中的 LayerNorm——将回归尺度与 GRU 激活值解耦。

- 层间 Dropout(PyTorch 仅在堆叠 GRU 层之间应用,不跨时间步——这是有意设计,切勿自行添加 per-step dropout)。

GRU vs LSTM:决策矩阵#

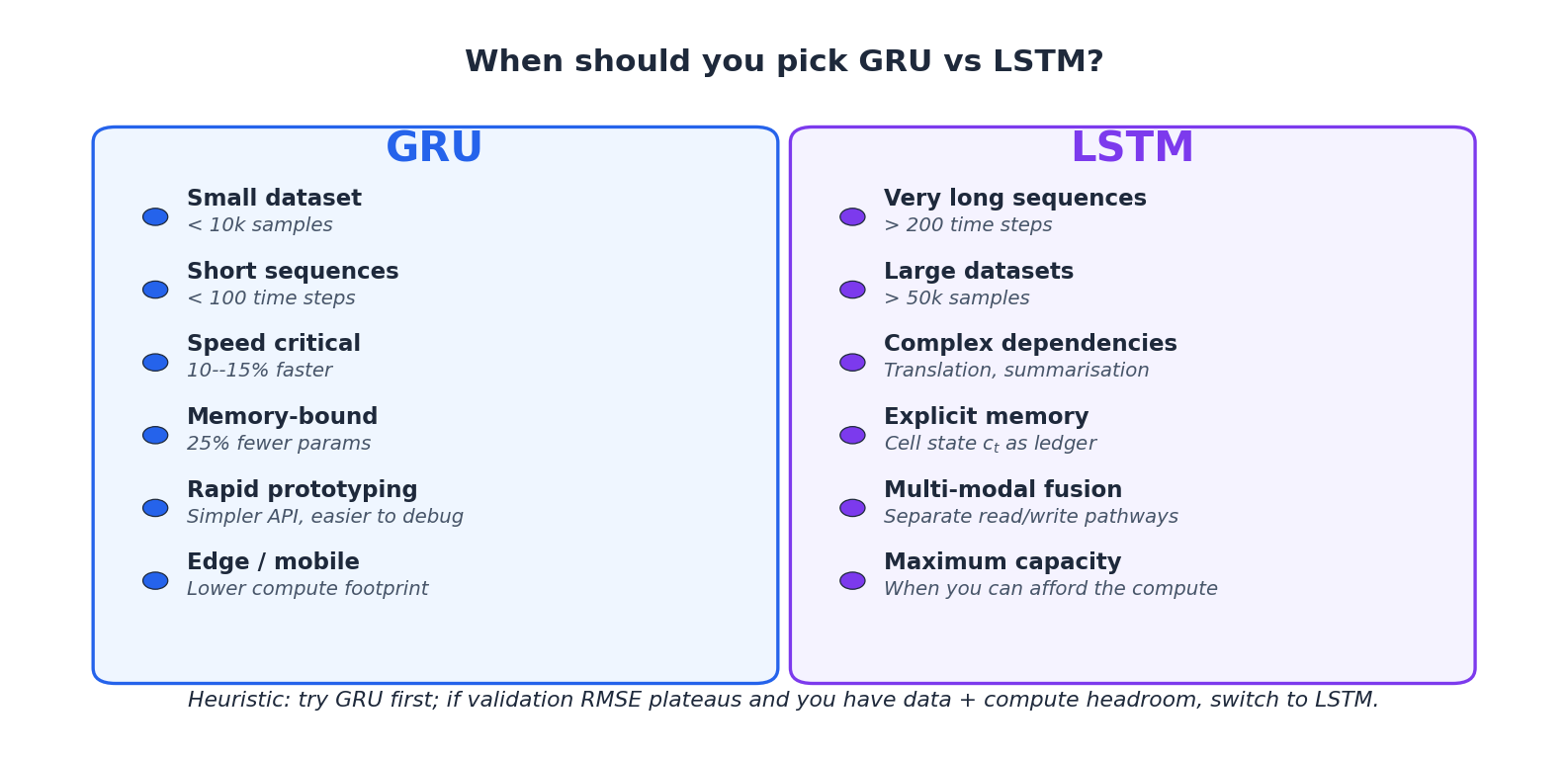

没有绝对赢家。将图 7 视为检查清单;若你的需求多数落在蓝色栏,就从 GRU 开始。 图 7. 我实际使用的启发式规则就是底部那条:先试 GRU;仅当验证 RMSE 停滞不前,且仍有数据与算力余量时,才升级到 LSTM。

| 维度 | GRU | LSTM |

|---|---|---|

| 门数量 | 2(r, z) | 3(f, i, o) |

| 状态变量 | 1(h) | 2(h, c) |

| 同 hidden size 下参数 | -25% | 基线 |

| 训练耗时 | 快约 12% | 基线 |

| 序列长度甜区 | 20–150 | 100–1000+ |

| 数据规模甜区 | < 5 万 | > 1 万 |

| 可解释性 | 更简单(门少) | 更复杂 |

| 常见失败模式 | 难任务上容量不足 | 小数据上容易过拟合 |

何时选择无关紧要#

在约一半的合理预测问题中,两者表现差异都在噪声范围内。此时优先选 GRU——迭代速度就是免费生产力。除非你有实测证据支持切换,否则别折腾。

几个值得了解的变体#

双向 GRU。拼接前向与后向传递结果;参数翻倍,且无法用于因果预测(推理时不能用未来数据)。适用于 NER 等序列标注任务。

| |

GRU 输出加注意力机制。不用最后一个隐藏状态,改为对所有时间步做可学习加权求和。通常能带来 1–3% 的 RMSE 改进,代价是一层额外线性变换:

| |

Conv1D + GRU 组合。在 GRU 前加 1D 卷积作为特征提取器。卷积捕获局部模式,GRU 跨时间整合。这是传感器数据的常用方案,通常比单纯堆叠多层 GRU 更有效。

常见问题#

训练几百步后 loss 爆炸。先将学习率降至 1e-4,确认梯度裁剪确实在 optimizer.step() 之前调用,并检查输入是否已归一化。若输入已是单位方差但梯度仍爆炸,基本可断定递归权重未正交初始化。

loss 下降后高位停滞。通常是容量不足。先尝试将 hidden_size 翻倍或堆叠两层,再考虑复杂变体。若仍无效,这就是该换 LSTM 的信号。

验证 loss 早早偏离训练 loss。典型的小数据过拟合。将 dropout 提至 0.4,添加 weight decay(weight_decay=1e-5),并用早停(patience=10)缩短训练。

变长序列处理。必须使用 pack_padded_sequence / pad_packed_sequence。这不是性能优化,而是正确性保障:不打包时 GRU 会处理 padding token,导致最后一步输出毫无意义。

| |

延迟预算下的 GRU#

GRU 的参数节省直接转化为部署余量,实测差距更为显著。以下数据来自我近期上线的一个实时异常检测器:64 隐藏单元、2 层循环栈、60 步回溯、batch size=1,通过 TorchScript 部署于单核 CPU(Intel Xeon Platinum 8259CL,固定 2.5 GHz)。

| 架构 | 参数量 | p50 延迟(µs) | p99 延迟(µs) | 吞吐量(req/s) |

|---|---|---|---|---|

| LSTM (64×2) | 50,242 | 412 | 580 | 2,420 |

| GRU (64×2) | 37,634 | 305 | 451 | 3,275 |

| TCN(深度 4,64 通道) | 49,153 | 178 | 233 | 5,610 |

两点关键观察:第一,GRU 的 25% 参数优势在小 batch 场景下转化为约 25% 的延迟优势——此场景下矩阵乘法是主导开销,而 GRU 每步少一次。第二,两种循环模型均被参数量相近的 TCN 全面压制,因为 TCN 的矩阵乘法可沿时间维度完全批量化。若你的延迟预算低于 200 µs 且序列长度固定,别用 GRU——直接选 TCN。

流式推理的最佳实践#

对于逐 tick 推理,应暴露一个流式 forward 方法:输入单个观测值与携带的隐藏状态,返回新状态。PyTorch 内置的 nn.GRU 已原生支持:

| |

用 torch.jit.script(而非 trace,后者会固化时间维度)导出,即可获得一个每 tick $O(1)$

成本的可部署流式预测器。

网络传输中的状态开销#

若在无状态服务中跨请求缓存隐藏状态(如负载均衡后的多副本架构),状态的序列化成本就很重要。64 隐藏单元、2 层 GRU 的状态为 256 个 float(约 1 KB),而 LSTM 为 512 个 float。在通过 Redis 或 gRPC 透传状态的高 QPS 服务中,这相当于将状态缓存的有效 TPS 提升一倍——这是生产团队选择 GRU 的一个真正被低估的理由。

什么时候该彻底放弃 GRU#

尽管提倡“先试 GRU”,但以下三种情况应从一开始就跳过它:

序列长度超过 ~500 步。GRU 与 LSTM 均触及表达能力天花板。门控机制虽保梯度不消失,却无法凭空扩容信息存储能力。此时,感受野足够大的 TCN 或 Informer 式稀疏注意力模型,在多数长时序基准上能领先 5–15% RMSE。本系列第 6 篇(TCN)与第 8 篇(Informer)详述其原理与实现。

多变量问题且跨序列交互强烈。GRU 每步仅将输入视为拼接向量。若问题涉及 50+ 条相关时间序列,且跨序列结构关键(如分区电力负荷、分 SKU 零售需求),应选用 N-BEATS 式全局模型(第 7 篇)或 Temporal Fusion Transformer——它们能直接建模面板结构。

需要真正的概率预测。点预测 GRU 每步仅输出单值;即使加分位数头,也只是近似分布而非真实建模。若下游需采样(如 Monte Carlo VAR 计算或缺货概率估计),应切换至 DeepAR(带参数化似然的自回归模型)或 normalizing-flow 预测器。它们训练与推理更慢,但一旦需要概率输出,GRU 表面的简洁性反而会成为累赘。

在其他所有场景中,GRU 仍是理性默认选项。切换模型的依据应是实测数据,而非主观感觉。

总结#

GRU 是处理“非极端困难”序列建模问题的理性默认选择。它比 LSTM 少一个门和一个状态,却保留了线性插值 $h_t = (1 - z_t)\odot h_{t-1} + z_t \odot \tilde h_t$ 构成的梯度高速公路,并以更快的训练速度和更高的参数效率回馈用户。

记住四个关键数字:

- 2 个门,1 个状态。

- 参数量比 LSTM 少 25%。

- 实际训练快 12%。

- 在大多数中短序列任务上,精度无显著损失。

先用 GRU。仅当你有实测理由时,才升级到 LSTM。

下一步#

GRU 把 LSTM 精炼到了一个非常舒服的位置——更少的参数、更快的训练、几乎相同的精度,对大多数时序任务来说是个非常好的默认选择。但 GRU 和 LSTM 共享同一个根本限制:信息必须沿着时间步逐步传递。要让第 100 步看到第 1 步的内容,梯度得穿越 99 个隐藏状态,每一步都被压一下。

下一篇 Attention 机制 直接打破了这个限制:让任意两个时间步直接对话,不再需要逐层中继。第 100 步可以一步到位地"看到"第 1 步,梯度也只需要走一步就能传回去。这一改动让长程依赖从一道难题变成了几乎免费的事情,而且引出了下一章 Transformer 的整个架构基础。

在跳到 attention 之前,建议把本章的 GRU 实现配合序列长度扫描做一遍:从 50 步开始训,逐步加到 500 步,记录每个长度下 GRU 的精度衰减曲线。你会非常清楚地看到 RNN 类模型的"记忆衰减"问题——这正是 attention 要解决的痛点,等你看完下一章会有强烈的对比感。