迁移学习(十二):工业应用与最佳实践

系列收官。把迁移学习推上生产线的实战指南:何时用、如何串成端到端管线、算力与美元的真实账单、四个标杆案例、A/B 测试、生产环境的分布漂移监控,以及 12 个月的 ROI 模型。

一家金融科技初创公司的三人团队仅用两周便上线了一套欺诈检测模型,性能超越了此前由 12 名工程师耗时六个月构建的旧系统。秘诀在于他们没有从零设计基于规则的集成模型,而是在 5,000 条标注交易数据上对预训练 Transformer 模型进行了微调——该模型上线首月即多识别出 23% 的欺诈行为,并将误报率降低了一半。当工程副总裁问及旧团队为何耗时如此之久时,答案很简单:他们没有采用迁移学习。

这个故事——人名已做脱敏处理——正在各行各业重演:凡是从“从头训练”转向“复用预训练基础模型”的团队,都在经历类似的跃迁,其经济性优势显著,不容忽视。但从“我们应当使用迁移学习”到“我们已建成一套能产生可衡量业务价值的迁移学习系统”之间,横亘着大量关键决策——这些决策在学术论文中往往只字未提。

这是系列文章的最后一部分,前十一部分讲了各种技术细节——预训练、微调、域适应、小样本与零样本学习、蒸馏、多任务学习、多模态、参数高效方法、持续学习和跨语言迁移。这一部分关注的是合上笔记本之后的工作:如何判断是否使用迁移学习、如何将其融入生产流水线,以及如何在半年后确认其有效性。

接下来的内容完全从需要长期维护模型的团队视角出发,而不是为了发论文的团队,两者的权衡点完全不同。

你将学到什么#

- 一个判断是否选择迁移学习的决策树;端到端生产流程的六个阶段,每个阶段的负责人和交付物;迁移学习能节省的算力和成本,达到三到五个数量级;四个标杆项目(Google Translate、ChatGPT、Tesla Autopilot、Copilot)及其背后的迁移技术演进

- 如何用统计学方法严谨地 A/B 测试两个迁移学习候选模型

- 如何在生产环境中监控分布漂移,并决定何时重新训练

- 一个可以调整后用于自己提案的 12 个月 ROI 模型

前置知识#

- 本系列前面的所有内容,尤其是第 9 章(PEFT) 、第 10 章(持续学习) 和第 11 章(跨语言) )

- 软件工程基础: API 设计、可观测性、部署流程

- 熟练掌握 PyTorch 训练循环

到底什么时候该用迁移学习#

迁移学习不是免费的。你得为一个超出需求的大模型骨干付出推理成本,还得接受预训练语料带来的偏见,甚至还要依赖上游模型的许可证和生命周期,而这些都不在你的掌控范围内。在决定是否使用迁移学习之前,先按照这张决策树一步步分析。

真正需要考虑的问题只有四个:

- 这个模态有没有现成的预训练模型? 如果没有——比如小众传感器数据、专有仪器日志——那就只能从头训练,而且至少需要 10 万以上的标注数据,或者设计一个可靠的自监督任务。

- 手头有没有至少 100 个标注样本? 如果少于这个数量,直接用前沿模型做提示工程的效果通常比微调更好。任务越复杂,这个临界点就越高。

- 业务领域和预训练语料是否接近? 比如通用网络文本和放射科报告、法律合同、工业日志的重合度很低。这种情况下,先做一轮领域自适应预训练(第 3 章 ),往往能省下后续微调的 GPU 成本。

- 是只服务一个任务,还是同时面向多个租户或任务? 如果多个租户共享同一个骨干模型, LoRA / Adapter (第 9 章 )可以让你为每个租户存储几 KB 的参数,而不是几 GB。

绝大多数时候,问题不是“用不用迁移”,而是“用哪种迁移方法”。图中底部的启发式规则是个不错的起点。与其纸上谈兵纠结选择,不如直接对比实验两个候选方案。

端到端的生产流程#

研究用的 notebook 写到 model.eval() 就结束了,但生产环境的工作才刚刚开始。下面这个流程是大多数团队在踩过几次坑之后总结出来的最佳实践。

整个流程分为六个阶段,每个阶段都有明确的负责人和交付物:

| 阶段 | 负责人 | 交付物 | 常见问题 |

|---|---|---|---|

| 基础模型 | ML 平台 | 冻结权重、tokenizer、评测套件 | 许可证悄悄变更 |

| 领域预训练 | 研究组 | 领域适配后的权重 | 灾难性遗忘 |

| 任务微调 | 业务团队 | Adapter 或全量权重、标签体系 | 训练和推理时 tokenization 不一致 |

| 压缩与导出 | MLOps | INT8 / 4-bit 权重、 ONNX / TensorRT 图 | 算子支持不全 |

| 服务化 | 平台 SRE | 容器、扩缩容配置、批处理策略 | 冷启动导致 P99 延迟升高 |

| 监控 | On-call | 漂移看板、评测金丝雀、告警路由 | 稀有场景下的静默失败 |

图中那条琥珀色的反馈箭头,是很多团队最容易忽视的部分。如果漂移检测不能自动触发再训练工单,那它就只是个摆设。 正确的做法是把监控告警直接接入再训练流水线,自动拉取新数据和缓存数据,生成一个候选模型用于 A/B 测试,而不是等着“下个 sprint 再看看”。

每个阶段都要记录可复现性检查点——模型权重、 tokenizer、评测集、数据哈希、 git SHA。这是 MLOps 中最重要的一条实践。没有这些,“3 月 14 号跑的那个模型”就会变成没人能还原的传说。

经济账:三到五个数量级的差距#

迁移学习能占领整个领域,不只是因为准确率高,更重要的是成本低。

拿一个 7B 参数的语言模型来说:

- 从零训: 大约需要 18 万 A100·小时,光算力成本就接近 45 万美元。

- 继续预训练: 在领域语料上继续训练,大约需要 1.2 万小时,花费 3 万美元左右。

- 下游全量微调: 大约需要 800 小时,花费 2,000 美元上下。

- rank=16 的 LoRA: 只需 40 小时左右,成本大概 100 美元。

- 提示工程调 API: 每次实验只需几美分。

具体数字会因硬件和软件的不同而变化,但整体趋势是稳定的——从“打基础”到“适配任务”,成本下降了五个数量级。这对项目规划有明确的指导意义:预算应该花在数据、评测和服务上,而不是训练算力。 如果一个团队把 80% 的预算用来微调一个还没验证是否适合自身场景的模型,那这笔钱就花错了地方。

还有一个细节需要注意:提示工程每次实验的成本很低,但每次请求的成本却很高。通常情况下,每天 10 到 1,000 次请求是一个临界点,超过这个点,微调一个小模型在摊销成本上更有优势。这件事一定要仔细计算清楚——一张服务成本的电子表格,比任何直觉都靠谱。

四个标杆部署#

具体案例比任何分类法都更能启发直觉。下面四个例子,分别展示了迁移学习的不同形态。

Google Translate (GNMT, 2016 年起)。 从每个语言对单独使用 LSTM seq2seq 模型,切换到一个统一的多语言 Transformer 编码器,这是多任务迁移在工业应用中最经典的胜利之一。一个模型支持 100 多个语言对,还能在训练时未见过的语言对之间实现零样本翻译。关键教训是:当任务之间存在共享结构时,跨任务的共享表示远远优于为每个任务单独建模。

OpenAI ChatGPT (2022 年起)。 GPT-3.5 和 GPT-4 的本质是基于 GPT-3 加了两层适配——先用监督指令微调,再通过 RLHF 进一步优化。基础模型承担了主要工作,而适配层让它变得可用。这就是现代的标准做法:一个小团队可以拿别人花大价钱训练好的大模型,用合适的偏好数据微调,就能打造出定义品类的产品体验。

Tesla Autopilot 的 HydraNet。 一个 ResNet 风格的骨干网络连接了 48 个任务专用头,包括车道检测、信号灯状态识别、深度估计、占据网格、交通标志识别等。这是第 6 章 提到的多任务学习在生产环境中的大规模实践:新增一个任务头几乎不增加成本,共享特征让改进一个任务的数据往往能顺带提升其他任务的表现,推理成本被 48 个输出一次性分摊。

GitHub Copilot (Codex)。 先在公开代码库上对预训练的 GPT 模型进行领域自适应预训练,再针对代码补全任务微调。这是第 3 章 提到的领域自适应预训练在行星级规模上的应用。从通用 GPT 到专精代码的 Codex,性能提升显著到足以定义一个全新的产品类别。

这四个案例的共同点不在于使用了哪个模型,而在于做产品的团队都没有自己训练基础模型。生产环境中的迁移学习,就是用别人的算力作为杠杆,撬动自己的创新。

工业级案例深度解析#

上述四个标志性部署展现了迁移学习的潜力边界。而以下案例——覆盖制造业、电商、金融与内容审核四大领域——则真实还原了落地一个迁移学习系统的全过程:从基线模型、关键技术选型,到踩过的坑与血泪教训。

制造业:产线 PCB 缺陷检测#

企业:中东欧中型电子制造商

任务: PCB 装配线视觉缺陷检测(12 类缺陷)

数据: 8,000 张标注图像(严重不均衡: 70% 为“无缺陷”, 4% 罕见缺陷类别每类 <50 张图)

基线:手工设计的 OpenCV 流水线(precision 0.74, recall 0.62)

方案:

- 预训练模型: ImageNet 上预训练的 EfficientNet-B3

- 领域自适应预训练:在 200,000 张未标注 PCB 图像上继续 SimCLR 自监督训练(100 epochs)

- 微调(fine-tuning):在 8,000 张标注数据上全参数微调,引入类别权重 + Focal Loss

- 主动学习(active learning):每周基于 QA 检验员对高不确定性样本的标注,触发模型重训

技术细节:

- 输入分辨率: 512×512 (消融实验选定;更高分辨率未提升性能,但推理耗时增至 3 倍)

- 类别权重按频率倒数设置,上限截断为 50×,防止训练失稳

- 在类别权重基础上叠加 Focal Loss (gamma=2),进一步聚焦难例

- 推理延迟 SLO: T4 GPU 单板 ≤80ms; TensorRT INT8 优化后达成 p95=47ms

效果:

- Precision: 0.91 (+23% vs 基线)

- Recall: 0.88 (+42% vs 基线)

- 6 个月内缺陷逃逸率下降 67%

- 年均节省质保索赔与返工成本约 $1.8M

关键经验:领域自适应预训练(SimCLR on unlabeled PCBs)是最大增益来源——跳过该步, F1 从 0.89 陡降至 0.79。 ImageNet 特征认识猫狗,但不认识虚焊桥接与元件缺失;唯有让模型“亲眼见过”产线缺陷,才能真正泛化。

电商:海量商品细粒度分类#

企业:东南亚电商平台(3,000 万月活用户)

任务:商品标题+图片多分类至 4,200 个叶子类目(长尾显著; Top 100 类目占总量 80%)

数据: 1,200 万条卖家标注数据(噪声高); 5 万条人工精标“金标”数据

基线: TF-IDF + 线性 SVM (top-1 准确率 0.71, top-5 准确率 0.86)

方案:

- 预训练模型: mBERT (文本编码器)+ ResNet-50 (图像编码器)

- 联合微调:双塔架构,文本与图像特征经共享分类头融合

- 分层损失(hierarchical loss): 4,200 类目按三级类目树(部门 → 子类 → 叶子)组织,各层级损失加权求和

- 人在环路(human-in-the-loop):每周将 top 5% 不确定预测送人工复核,新增标签回流训练集

技术细节:

- 卖家标注准确率仅 78%,直接训练会触达性能天花板。采用两阶段策略:先用 1,200 万噪声数据预训练分类头,再用 5 万金标数据全模型微调

- 图文融合在歧义场景收益最大(如标题“white box”可能是手机壳、路由器或厨房电器;图像可解歧)

- 长尾处理:对样本 <20 的叶子类目,模型默认输出其父类预测,而非强行猜叶子——降低混淆,提升用户体验

效果:

- Top-1 准确率: 0.84 (+18% vs 基线)

- Top-5 准确率: 0.96 (+11% vs 基线)

- 商品错分投诉下降 54%

- 搜索相关性与转化率提升约 4% (A/B test 验证)

关键经验: Focal Loss 与人在环路路由对长尾至关重要。单纯以全局准确率为优化目标的微调模型,在罕见类目上必然失效,直接损害用户体验。

金融:交易欺诈识别#

企业:北美支付服务商

任务:二分类(交易是否欺诈)

数据: 500 万标注交易(欺诈率 0.8%); 5 亿未标注交易

基线: XGBoost (120 个人工特征工程特征), F1=0.68, precision=0.54, recall=0.89

方案:

- 预训练模型: TabTransformer (在 5 亿未标注交易上通过掩码自监督预训练)

- 微调:在 500 万标注数据上全参数微调,欺诈类权重设为 100×

- 集成:微调 TabTransformer + XGBoost 的堆叠集成(元学习器:逻辑回归)

技术细节:

- 特征工程减负: TabTransformer 直接从原始离散/连续特征(商户 ID、金额、时间、位置等)学习表征,替代 80% 人工特征工程流水线

- 不均衡处理: 0.8% 欺诈率下,标准训练易坍缩为全预测“非欺诈”。组合使用 SMOTE 过采样 + Focal Loss (gamma=2)

- 时间验证(temporal validation):随机划分导致数据泄露(欺诈模式具强时间相关性)。改用时间切分: 1–10 月训练, 11 月验证, 12 月测试

- 概念漂移(concept drift)应对:欺诈模式周级演化。实施双周重训机制,配合模型版本管理与 A/B test 上线前验证

效果:

- F1: 0.79 (+16% vs 基线)

- Precision: 0.71 (+31%,显著降低误拒带来的客户摩擦)

- Recall: 0.89 (保持)

- 6 个月内额外拦截欺诈损失 $4.2M

- 误拒率下降 28%,客户满意度提升

关键经验:时间验证是防过拟合的生命线。初期随机划分测试集显示 F1=0.84,但上线后生产 F1 骤降至 0.61 (灾难性失败)。切换时间验证后获得真实性能评估,避免项目夭折。

社交媒体:多语种内容审核#

企业:中东地区社交网络(4,000 万用户)

任务:多标签分类(仇恨言论、暴力、垃圾信息、色情内容等,共 12 标签)

数据: 5 万条阿拉伯语+英语混用(code-switching)标注帖文; 1,000 万未标注帖文

基线:外包人工审核(年成本 $1.2M)

方案:

- 预训练模型: XLM-RoBERTa (跨语言 RoBERTa, 100 种语言预训练)

- 自监督预训练:在 1,000 万未标注站内帖文上继续 MLM 预训练(50,000 steps)

- 微调:多标签分类头, 10 epoch, Binary Cross-Entropy Loss

- 主动学习:每周重训,向审核员查询高不确定性样本

技术细节:

- 混合语种: 35% 帖文单句内阿拉伯语+英语混用。 XLM-RoBERTa 跨语言嵌入天然支持;单语模型失效(阿拉伯语 BERT: F1=67%,英语 RoBERTa: F1=61%, XLM-RoBERTa: F1=83%)

- 多标签阈值调优:各标签最优决策阈值不同(垃圾信息: 0.3,仇恨言论: 0.6…),通过验证集网格搜索逐标签调优

- 对抗鲁棒性:恶意用户故意拼写错误规避检测。训练数据加入字符级扰动增强鲁棒性

- 延迟要求:实时审核需 <50ms。 ONNX + TensorRT 在 T4 GPU 上实现 p95=32ms

效果:

- Macro-F1: 0.81

- 自动化 70% 审核决策,人力成本年降 $840,000

- 平均审核时长从 18 小时压缩至 2 分钟

- 用户举报的内容质量评分提升 22%

关键经验:在站内未标注数据(混语社交帖文)上继续预训练,比直接使用 XLM-RoBERTa 原始 checkpoint 更有效——领域适配使 F1 从 0.74 提升至 0.81,决定项目是“勉强可用”还是“颠覆性落地”。

A/B 测试两个迁移学习候选模型#

离线评测中表现更好的新模型只是一个假设,不能直接作为上线依据。生产环境中的随机对照实验才是唯一的可靠答案。

图中的实验是一个典型配置: BERT-base 全量微调(对照组)和 RoBERTa-large + LoRA (实验组)按 50/50 分流,持续运行 14 天。每日转化率附带 95% 置信区间。第 9 天达到最小样本量,第 14 天 Welch t 检验结果显示 $t = 3.42$ 、$p = 0.002$ ,转化率提升 6.5%, p99 延迟指标保持稳定,基础设施成本下降 18%。决策:全量上线。

经验告诉我几条重要的规则:

- 提前定义成功指标和护栏指标。 如果事后才决定哪个指标“真正重要”,那就是在 p-hacking。

- 用 Welch t 检验,别用 Student t 检验。 两组数据的方差几乎不可能相等。

- 关注异质性处理效应: 模型可能在总体上表现更好,但在某些关键用户群体上却输了。批准全量上线前,按语言、设备和租户切分结果。

- 至少跑满一个完整的业务周期。 工作日和周末的行为模式差异可能完全改变结论。

- 即使上线后也要保留一个小流量对照组。 这样当外部环境变化时,还能及时发现性能回退。

对于低流量服务,序贯检验(比如 mSPRT)可以提前终止实验,同时控制假阳性率。高风险变更则应先运行一段影子模式,让新模型静默预测并记录日志,而不实际影响用户。

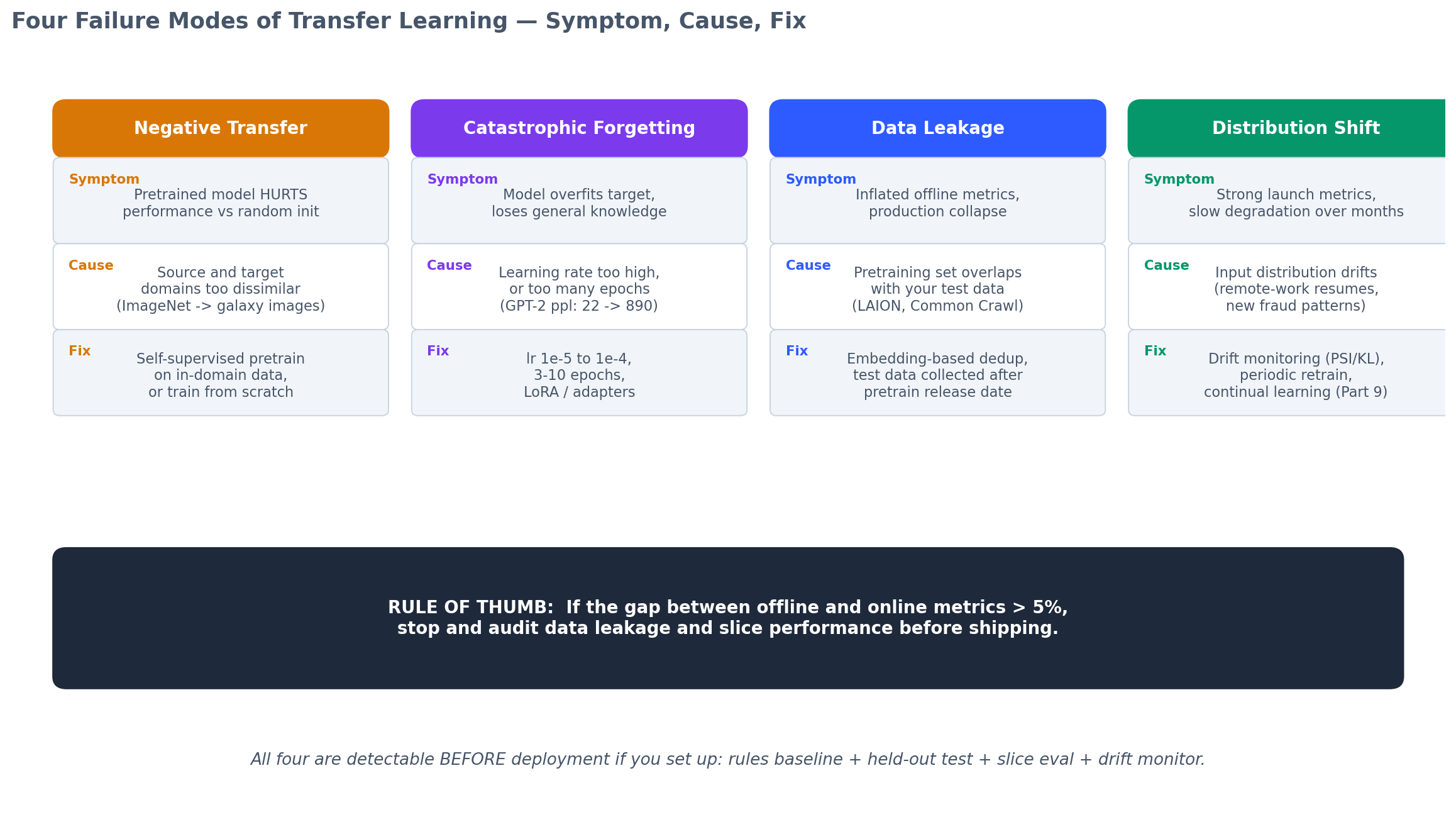

迁移学习失效的场景与五大常见错误#

并非所有迁移学习项目都能成功。常见失效模式如下:

负向迁移(Negative Transfer)

预训练模型的表现 比从零训练更差。

原因: 源域与目标域差异过大,预训练特征在微调过程中产生误导。

示例: 在天文图像(星系形态分类)任务上微调 ImageNet 预训练的 ResNet。 ImageNet 特征侧重物体边界与纹理;而星系呈弥散、低对比度结构。最终性能反而低于随机初始化的 ResNet。

应对: 使用目标领域无标注数据进行自监督预训练,或直接从零训练。

灾难性遗忘(Catastrophic Forgetting)

微调过程严重损害了预训练模型的通用知识,导致其在小规模目标数据集上过拟合。

原因: 学习率过高,或微调轮数过多。

示例: 用 500 条客服对话对 GPT-2 微调 50 轮(lr=1e-3)。模型记住了全部样本,语言建模能力大幅退化(在通用语料上的困惑度从 22 升至 890)。

应对: 降低学习率(1e-5 ~ 1e-4)、减少微调轮数(3–10 轮),或采用参数高效微调方法(LoRA、 adapters)以保留基础模型能力。

数据泄露(Data Leakage)

预训练数据与你的测试集存在重叠,导致性能评估虚高。

原因: 大规模网络爬取预训练数据集(如 LAION-5B、 Common Crawl)可能已包含你的评测基准。

示例: 某团队在专有图像检索任务上微调 CLIP,报告准确率达 96%;后经核查发现其测试集 15% 的图像存在于 LAION-5B (CLIP 的预训练数据)中。剔除泄露样本后真实准确率仅为 81%。

应对: 使用基于嵌入的近似重复检测工具排查数据重叠;构建严格隔离的测试集——数据采集时间必须 晚于 预训练模型发布日期。

部署后分布偏移(Distribution Shift After Deployment)

模型上线初期表现良好,但随时间推移因输入分布漂移而持续退化。

示例: 一个基于 2019–2020 年简历微调的职位推荐模型, 2020 年上线时 F1 = 0.88;到 2021 年中,因远程办公趋势改变简历措辞与职位描述, F1 已降至 0.72。

应对: 持续监控输入/输出分布;定期重训练,或采用持续学习(continual learning)策略,在适应新分布的同时避免遗忘。

五大常见错误#

除上述技术性失效外,组织与流程层面的失误往往在项目启动前就已埋下失败种子。以下是最高频的五类错误:

错误 1:跳过基线实验(Skipping the Baseline)

团队耗时 6 周微调 SOTA 模型,达成 87% 准确率并上线;随后才发现一个简单规则系统即可达到 91%。

为何发生: 迁移学习令人兴奋,写 if-else 却很枯燥——但枯燥的方案常常胜出。

应对: 务必首先实现最简基线(规则、逻辑回归、小型决策树)。若迁移学习仅比基线高 <5%,需严肃评估其额外复杂度是否值得。

错误 2:忽视推理成本(Ignoring Inference Cost)

模型离线指标优异,但线上单次推理成本高达 $0.15,产品无法承受,模型终被弃用。

应对: 设计阶段即计算「单次推理成本 × 预估请求量」。例如:微调 BERT 单次成本 $0.02,月请求量 1000 万 → 月成本 $ 200,000。能否通过蒸馏或量化将 90% 请求成本压至 $0.001?

错误 3:在测试集上调参(Tuning on the Test Set)

团队反复调整超参并查看测试集结果,最终测试准确率达 94%;上线后实际准确率仅 79%。

应对: 将测试集视为 只写(write-only)资源:所有决策定稿后,仅允许评估一次。调参全程使用独立验证集。

错误 4:未部署监控即上线(Shipping Without Monitoring)

模型上线后前两月表现良好,随后悄然退化;半年后重大事故才暴露其已持续数月欠佳。

应对: 监控不是可选项。至少需追踪:(1)预测分布随时间变化,(2)输入特征分布,(3)业务指标(CTR、转化率等);并对异常设置告警。

错误 5:过度复杂化架构(Overcomplicating the Architecture)

团队微调预训练模型后,又“增强”了自定义注意力层、多任务辅助头、多阶段训练、集成技巧等,最终系统需 14 步训练、 3 人维护。

应对: 除非带来显著且可测量的提升,否则拒绝增加复杂度。某视频分类团队起始于微调 TimeSformer (F1 = 0.83),后续叠加光流(+0.01)、音频嵌入(+0.02)、时序集成(+0.01)、 TTA (+0.01),最终 F1 = 0.88 —— 但训练耗时从 4 小时增至 19 小时,部署需 3 套独立推理流水线。他们最终选择上线基础模型,并将节省的工程资源投入更多数据标注。

监控分布漂移#

模型不会突然失效。它们会慢慢漂移——训练时的世界悄然变化,准确率每天下降一点点。等到季度复盘时才发现,系统已经默默低效运行了三个月。

标准做法是结合无监督的分布指标和有监督的准确率金丝雀:

- 分布指标:每天在滚动窗口上计算生产环境特征分布与训练分布之间的 KL 散度(也可以用 PSI 或 KS 统计量)。 KL 散度的好处是解释直观——归一化特征上超过 $0.15$ 就需要注意。具体阈值要根据服务调整。

- 有监督金丝雀:一个小规模的 holdout 集,最好每周更新一批人工标注数据,用来评估线上模型的表现。这能发现输入分布看似不变但标签分布已偏移的情况。

图中两个信号在第 24 天左右同时越界——KL 散度超过 0.15,准确率跌破 85% 的 SLO。这时再训练流水线自动触发。这就是让系统在实际环境中持续运行的关键闭环。

一个常见误区是只看分布指标,不用标注金丝雀。 KL 散度可能因为良性变化(比如新产品上线或流量结构改变)而升高,但准确率并未受影响。每次 KL 波动都告警会让团队对警报麻木。只有当分布漂移和准确率下降同时发生时,才是高精度的触发条件。

ROI:如何讲好商业价值#

工程师往往低估迁移学习项目的商业价值,因为他们只算了 GPU 的账单。如果把成本和收益放在同一张图上对比,说服力会强得多。

举一个典型的单模型项目为例:

- 初期投入(工程开发、领域预训练、数据标注):大约 8 万美元。

- 持续开销(服务运行、监控维护、 On-call 支持):每月约 6000 美元。

- 收益(替换规则引擎、减少外部采购、挽回转化率损失):第 1 个月收益为 5000 美元,到第 6 个月稳定在每月 5 万美元。

- 回本时间是第 5 个月;第一年的投资回报率(ROI)达到 $+150\%$ 。

即使把收益预估砍半,曲线的整体趋势依然成立。真正让这类项目失败的不是收益增长太慢,而是团队上线模型后撒手不管,导致模型性能因漂移而衰退,还没等到回本就失去了价值。说到底,论证 ROI 和强调监控其实是同一件事。

如果要提一个新的迁移学习项目,我会准备三份材料:

这三份材料足以应对任何有思考深度的赞助人可能提出的问题。

最小可用的生产方案#

去掉所有冗余,一个生产级迁移学习服务的第一版可以浓缩到一屏代码里。

| |

要让这段脚本变成一个完整的系统,还需要补四块内容:每周更新的标注 holdout 数据集、带 On-call 路由的漂移仪表盘、 A/B 测试框架、以及可以直接触发再训练的流水线。按照这个顺序搭建就行。

常见问题#

Q1:用闭源 API 还是自托管开源模型? 做原型、低流量任务,或者前沿模型明显优于开源模型时,选 API。如果日活流量超过成本临界点,有数据驻留需求,或者延迟 SLA 要求低于 200 毫秒,就自托管。很多团队最后两种方式都会用。

Q2:微调需要多少数据? 如果有一个强大的预训练骨干模型,每类准备 100 到 1,000 个标注样本,通常就能超越精心设计的提示词。如果数据量少于这个范围,用前沿模型做提示工程效果会更好。

Q3:生产环境里全量微调还是 LoRA? 如果一个底座模型要服务多个租户或多种任务,选 LoRA——每个租户只需存储几 KB 的适配器参数。如果是单一高风险任务,且能负担得起部署完整模型,就全量微调。只有当目标设备无法容纳参数高效的方案时,才考虑蒸馏。

Q4:什么时候该重新训练? 当分布漂移和标注金丝雀准确率下降同时发生时,就需要重新训练。不要按固定时间表重训,现实世界不会按照 cron 任务运行。

Q5:如何避免再训练时的灾难性遗忘? 把一部分旧分布的数据混入新训练集,或者使用 EWC 或 LoRA + replay (第 10 章 )。每次训练后,一定要在之前的测试集上评估,作为保护机制。如果模型在新数据上提升 3 分,但在旧数据上下降 5 分,这就是退步,不是进步。

Q6:离线评测的提升上线后没复现,为什么? 几乎可以肯定是训推不一致、标签泄露,或者评测集和线上流量的人群分布差异导致的。解决方法是运维层面的:确保预处理完全一致,检查评测集的构成,然后重新跑 A/B 测试。

一段话总结整个系列#

我先从迁移学习的“为什么”和形式化定义讲起(第 1 篇),然后介绍了经典的“预训练+微调”方法(第 2 篇)。第 3 篇和第 11 篇讨论了域漂移和语言漂移;第 4 篇和第 7 篇聚焦小样本与零样本场景;第 5 篇展示了如何通过蒸馏压缩模型收益;第 6 篇扩展到多任务学习;第 8 篇延伸至多模态;第 9 篇讲解了如今驱动大多数生产微调的参数高效适配方法;第 10 篇探讨了如何持续更新模型而不遗忘已有知识。最后这篇想强调的是:以上内容都是必要的,但还不够。要真正落地迁移学习,必须掌控六个关键要素:决策、流水线、经济性、实验设计、监控体系和 ROI 分析。把这六点搞定,剩下的就是工程实现了。

参考文献#

- Howard, J., & Ruder, S. (2018). Universal language model fine-tuning for text classification. ACL.

- Wei, J., & Zou, K. (2019). EDA: Easy data augmentation. EMNLP.

- Yun, S., et al. (2019). CutMix: Regularization strategy. ICCV.

- Wu, Y., et al. (2016). Google’s neural machine translation system: Bridging the gap between human and machine translation. arXiv:1609.08144 .

- Ouyang, L., et al. (2022). Training language models to follow instructions with human feedback. NeurIPS.

- Chen, M., et al. (2021). Evaluating large language models trained on code. arXiv:2107.03374 .

- Sculley, D., et al. (2015). Hidden technical debt in machine learning systems. NeurIPS.